作者信息

【原文作者】 数智与AI

【作者简介】 专注于数据分析与应用、数字化转型、AI人工智能的趋势、应用与实践内容分享。

【微 信 号】 allfordata

文章摘要

【关 键 词】 LLM微调、数据准备、模型选择、性能评估、迭代优化

LLM大模型微调概述

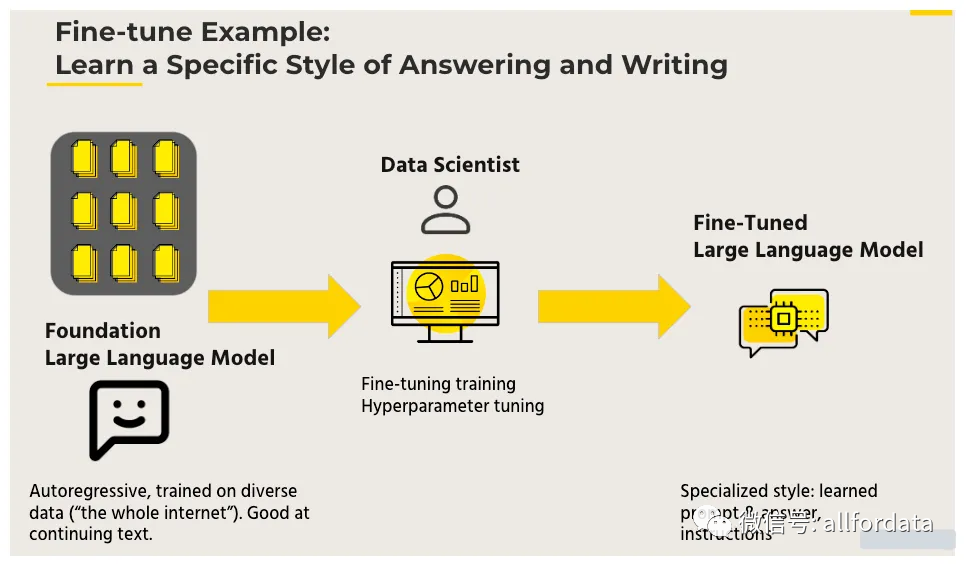

LLM大模型微调是一个专门化的过程,旨在提高大型语言模型(如GPT-3或GPT-4)在特定任务或领域中的表现。这个过程从一个广泛训练的通用模型开始,通过在特定数据集上进行训练来调整模型的权重,从而使其在特定任务上更加精确。

微调过程的关键步骤

1. 数据准备:首先,需要收集和准备与目标任务相关的数据集,这些数据应包括输入示例和期望的输出。

2. 模型选择:接着,选择一个适合任务的预训练LLM作为基础模型。

3. 模型调整:使用机器学习技术在特定数据集上训练模型,调整权重以提高任务性能。

4. 评估和迭代:微调后,需要在独立数据集上评估模型性能,并根据结果迭代优化。

微调项目实施指南

1. 定义目标:明确微调的任务和成功的标准。

2. 数据收集和准备:收集高质量的相关数据,并确保数据标记准确。

3. 选择正确的基础模型:选择合适的预训练LLM,并考虑模型大小与资源需求。

4. 微调过程:设置计算环境,实施微调程序,并采用正则化技术防止过拟合。

5. 评估和迭代:测试模型性能,分析结果,并根据需要进行迭代改进。

6. 实施和监控:部署模型,并持续监控其性能以确保效果和合规性。

7. 伦理和法律考虑:关注模型的伦理影响,并确保合规性。

8. 其他提示:保持详细的文档记录,并利用社区资源。

总结

微调LLM是一个涉及多个步骤的复杂过程,需要精心规划和执行。它包括数据准备、模型选择、训练调整、性能评估和迭代优化。此外,还需要考虑计算资源、数据质量、正则化、过拟合、伦理和法律问题。成功实施微调项目需要数据科学家、领域专家和软件工程师的协作。

原文信息

【原文链接】 阅读原文

【原文字数】 1282

【阅读时长】 5分钟