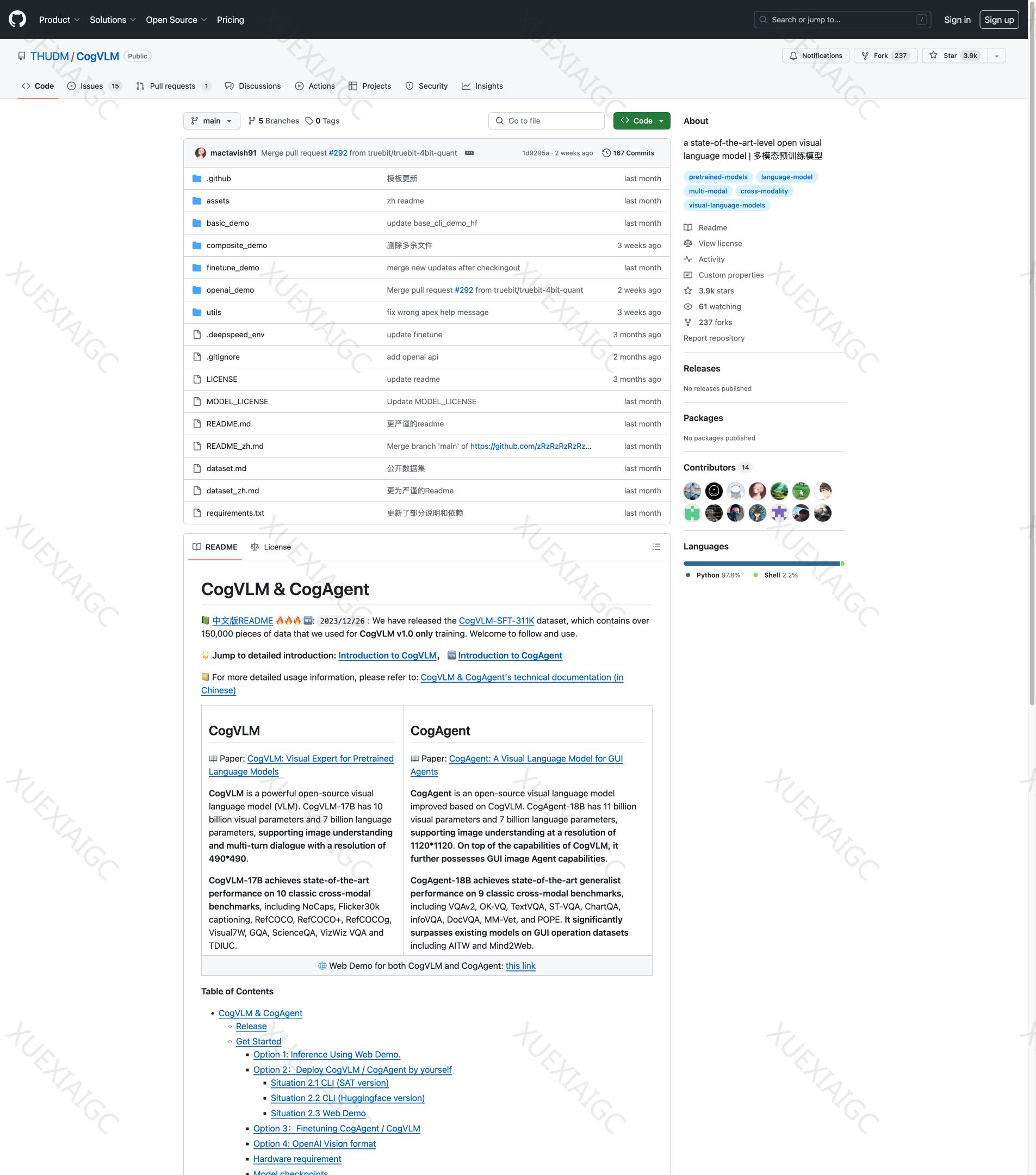

CogVLM是一个强大的开源视觉语言模型。CogVLM-17B拥有100亿的视觉参数和70亿的语言参数,支持490*490分辨率的图像理解和多轮对话。CogVLM-17B在10个经典的跨模态基准测试中取得了最佳性能,包括NoCaps, Flicker30k captioning, RefCOCO, RefCOCO+, RefCOCOg, Visual7W, GQA, ScienceQA, VizWiz VQA和TDIUC,并在VQAv2, OKVQA, TextVQA, COCO字幕等方面排名第二,超越或匹敌PaLI-X 55B。CogVLM还可以和您聊关于图片的话题。

CogAgent:基于CogVLM的视觉语言模型

CogAgent是基于CogVLM改进的开源视觉语言模型。CogAgent-18B拥有110亿的视觉参数和70亿的语言参数,支持1120*1120分辨率的图像理解。在CogVLM的能力之上,CogAgent进一步拥有了图形用户界面(GUI)Agent的能力。

CogAgent在9个经典的跨模态基准测试中实现了最先进的通用性能,包括VQAv2, OK-VQ, TextVQA, ST-VQA, ChartQA, infoVQA, DocVQA, MM-Vet, 和 POPE测试基准。它在如AITW和Mind2Web等GUI操作数据集上显著超越了现有的模型。除了CogVLM已有的所有功能(视觉多轮对话,视觉定位)之外,CogAgent支持更高分辨率的视觉输入和对话式问答,拥有视觉Agent的能力,并通过改进预训练和微调,提高了OCR相关任务的能力。

数据统计

相关导航

暂无评论...