作者信息

【原文作者】 与数据同行

【作者简介】 傅一平博士创办的大数据公众号,分享数据领域的实践经验、思考感悟和学习体会!

【微 信 号】 ysjtx_fyp

文章摘要

【关 键 词】 Transformer、GPT、InstructGPT、ChatGPT、大模型

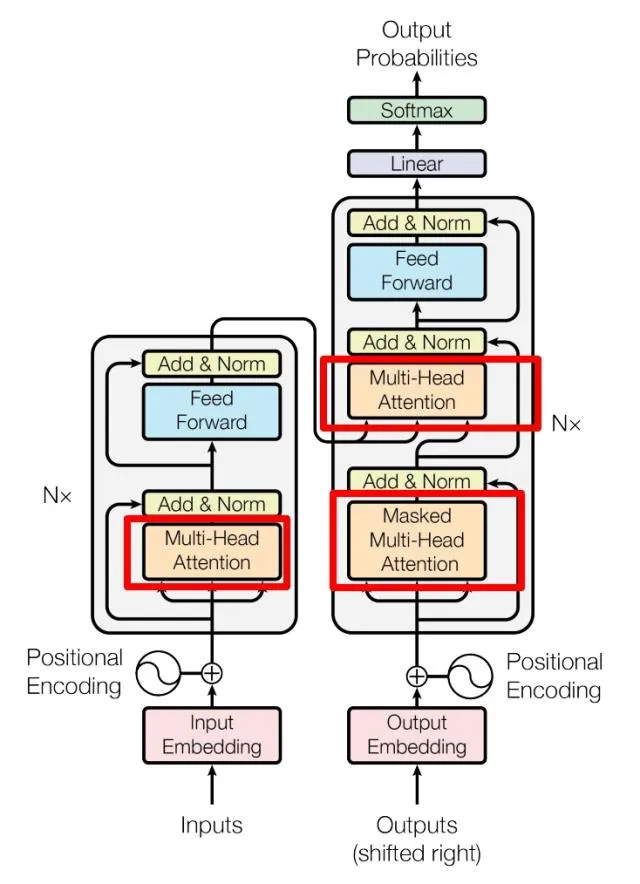

在近期的文章中,介绍了一系列与人工智能相关的概念,其中包括了Transformer、GPT、InstructGPT、ChatGPT、大模型等。Transformer是一种基于自注意力机制的深度学习模型,被广泛应用于自然语言处理任务。GPT是OpenAI开发的基于Transformer的大规模自然语言生成模型,通过自监督学习进行预训练,并在微调阶段适应特定任务。InstructGPT是为了解决GPT在实际应用中出现的问题而提出的概念,通过强化学习技术微调模型以更好地理解用户意图。ChatGPT是在GPT-3.5基础上通过无监督学习和强化学习技术微调而成的模型,提供了问答交互的服务。大模型是指具有大量参数的语言模型,如GPT系列等。

另外,文章还介绍了自监督学习、自注意力机制、零样本学习、AI对齐等概念。自监督学习是一种从数据本身找标签进行有监督学习的技术,常用于预测文本中的下一个单词等任务。自注意力机制是一种捕获序列数据中不同位置之间相互依赖性的技术,能够捕获长距离的依赖关系。零样本学习解决在测试阶段未出现但可能出现的类别的分类问题,需要模型具备推广和推理能力。AI对齐是指让人工智能模型的产出与人类的认知和价值观保持一致的技术。

此外,还介绍了词嵌入技术,将词语映射到向量空间,捕捉词语的语义和语法特征,使计算机更好地理解和处理文本。这些概念和技术共同构成了人工智能领域的重要基础,推动着AI技术的不断发展和应用。

原文信息

【原文链接】 阅读原文

【原文字数】 10494

【阅读时长】 35分钟