文章摘要

【关 键 词】 OpenAI、安全主管、模型安全、LLM幻觉、华人科学家

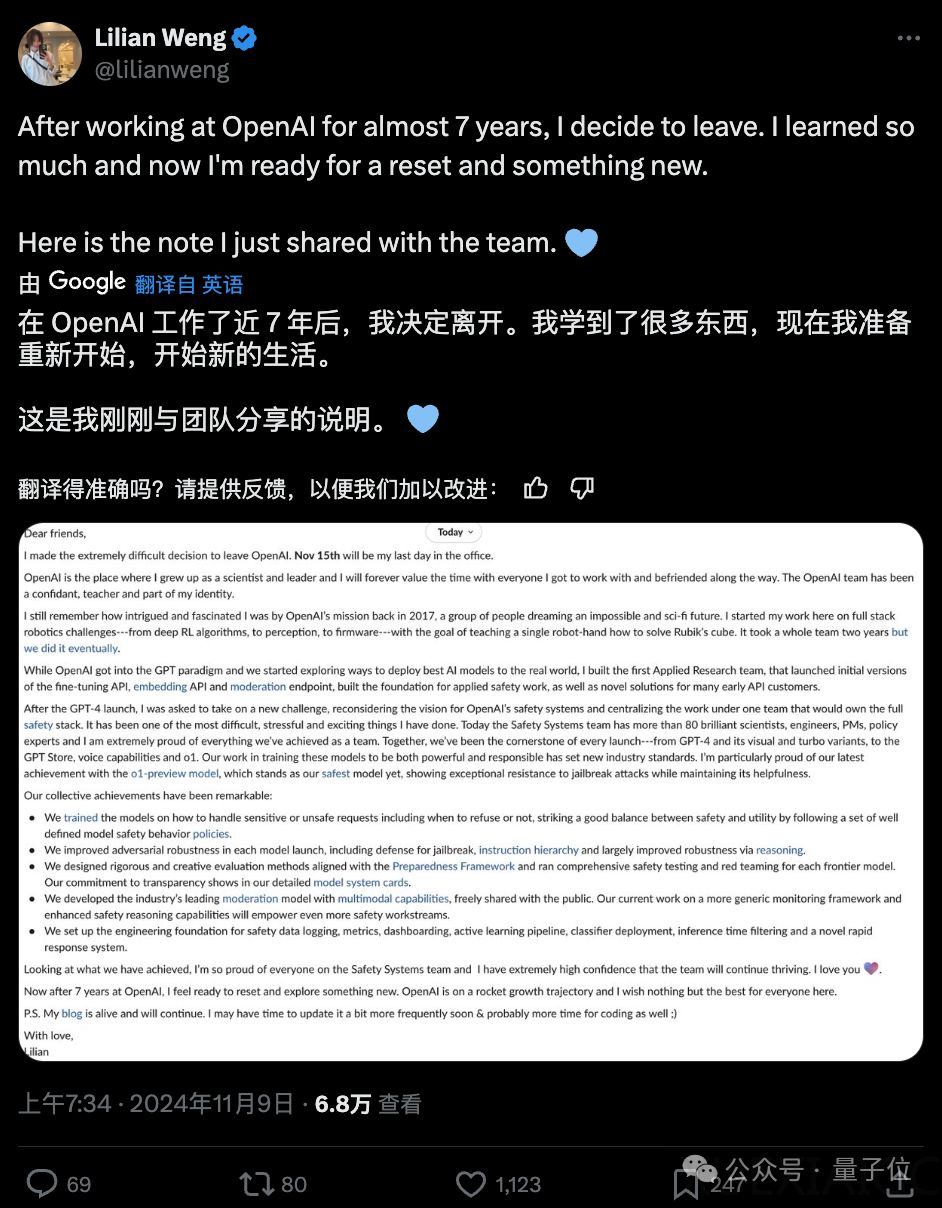

OpenAI的研究副总裁(安全)翁荔宣布离职,她曾是ChatGPT的贡献者之一。翁荔在北京大学毕业后加入OpenAI,参与GPT-4项目,专注于预训练、强化学习、模型对齐和安全性。她提出了著名的Agent公式,即Agent=大模型+记忆+主动规划+工具使用。翁荔在离职信中回顾了她在OpenAI的成就,包括建立应用研究团队、推出微调API、嵌入API和审核端点,以及在GPT-4发布后负责整个安全体系的团队。她为团队在模型安全、对抗性鲁棒性、测试方法、透明度、审核模型和工程基础等方面的成就感到自豪,并表示对团队的未来充满信心。

OpenAI的安全主管职位自公司成立以来经历了多次更替。达里奥·阿莫代伊是首位安全主管,他领导了GPT-3的安全评估。阿莫代伊离开后,亚历山大·马德里短暂担任安全主管,聚焦新模型能力评估和内部红队测试。随后,杨·莱克担任安全主管,推动使用小型模型监督和评估大型模型的研究。翁荔于2024年7月成为安全主管,领导安全系统团队解决ChatGPT等模型的滥用问题。她的离职后去向受到关注。

翁荔是OpenAI华人科学家,本科毕业于北大,后在印第安纳大学伯明顿分校攻读博士。她在Facebook实习后,加入Dropbox担任软件工程师,并于2018年加入OpenAI。翁荔在Google Scholar的引用量达到13000+次,她提出的LLM外在幻觉概念受到广泛关注。

原文和模型

【原文链接】 阅读原文 [ 2086字 | 9分钟 ]

【原文作者】 量子位

【摘要模型】 moonshot-v1-32k

【摘要评分】 ★★☆☆☆

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...