文章摘要

【关 键 词】 AI领域、Karpathy、GPT-2、高效训练、自由工作

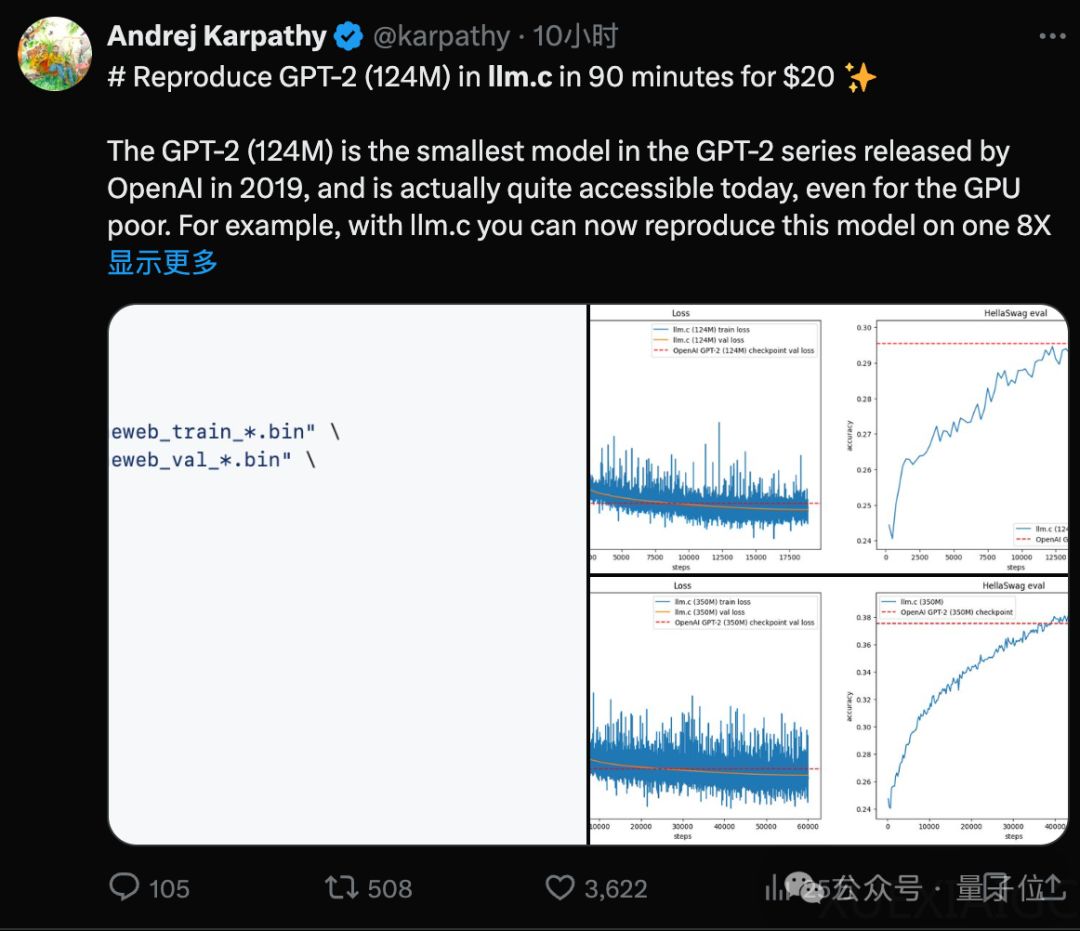

AI领域的大神Karpathy近日成功复现了OpenAI的经典成果GPT-2,而且仅用了20美元、90分钟就完成了训练,令人震惊的是,其Loss和评测还超越了原版。他使用的是A100云服务,训练的是124M版本的GPT-2,并把自己的成功过程写成了完整教程,引起了广泛关注。

Karpathy此次复现GPT-2是基于他的llama.c代码库,许多超参数设置遵循了GPT-3的标准。他认为,按照Chinchilla定律的标准,GPT-2在100B tokens上训练应属于过度训练,124M模型按计算2.5B tokens就足够。然而,他实际上训练了10B tokens,并且使用了质量更高的FineWeb数据集,这可能是评测分数超越原版的原因。

此外,有网友注意到,Karpathy在训练时的GPU利用效率也比OpenAI的工作高,这主要因为他用的是单个云服务节点,无需考虑服务器间通信问题。他还自费200美元为大家复现了350M版本的GPT-2,并且同样取得了超越原版的成绩。

在生活方式方面,自今年二月份从OpenAI辞职后,Karpathy的生活节奏并非人们想象中那么“卷”。他的GitHub热力图显示,他在开始休息了一段时间后,从4月份开始变得越来越活跃。但实际上,他的工作时间安排比较自由,一周工作4-20小时不等,甚至还会出去旅游放松。

他分享了自己的自由职业心得:起床后直接开始工作,避免被外界信息分散注意力。这种工作方式或许能为其他自由职业者提供一些借鉴。

原文和模型

【原文链接】 阅读原文 [ 1514字 | 7分钟 ]

【原文作者】 量子位

【摘要模型】 glm-4

【摘要评分】 ★★★☆☆

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...