Ilya参与,OpenAI给GPT-4搞可解释,提取了1600万个特征,还能看它怎么想

文章摘要

【关 键 词】 人工智能、大语言模型、神经活动、特征提取、监控控制

在人工智能领域,大语言模型(LLM)正受到广泛关注,因其强大的语言理解和生成能力在各种应用中展现出巨大潜力。然而,这些模型的内部运作机制,特别是神经活动的方式,仍然是一个未解之谜。OpenAI最新的研究在此方面取得了重要进展,提出了一种能够对大型模型如GPT-4进行“扫描”,揭示其思路的方法,并将该方法开源。

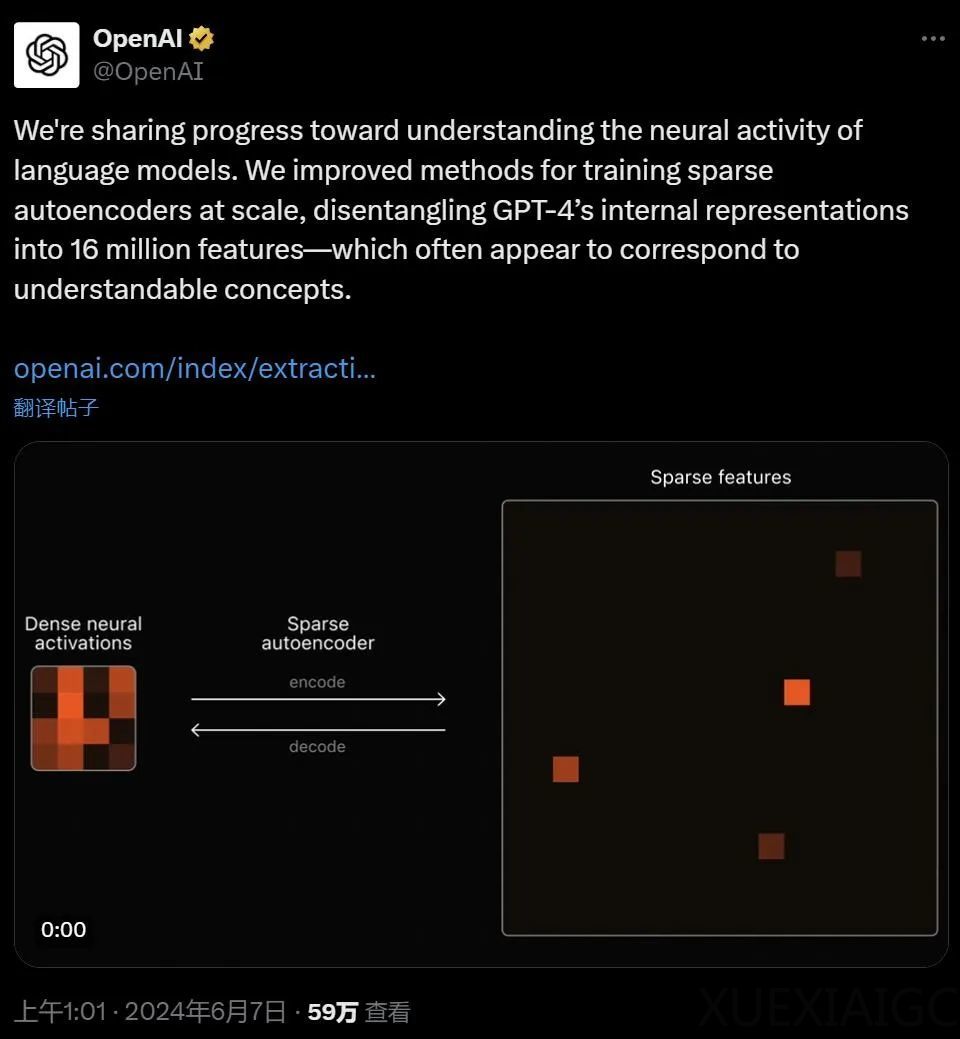

研究团队开发了一种稀疏自动编码器,这是一种识别神经网络中关键特征的方法,这些特征对于理解模型的输出至关重要。这些特征以稀疏的激活模式存在,与现实世界中概念的相关性保持一致。尽管训练稀疏自动编码器并捕捉到大型语言模型中的特征面临诸多挑战,但OpenAI的方法显示出可扩展性和稳定性,并在GPT-4上成功训练出1600万个特征。

具体来说,研究团队在GPT-2 small模型和一系列基于GPT-4架构的模型上训练了自动编码器,选择了靠近网络末端的一层进行特征提取。通过新引入的评估指标和可视化工作,OpenAI发现了可解释的特征,如与人类缺陷、价格上涨、反问句等相关的概念。

尽管如此,这项技术仍处于早期阶段,存在局限性。许多特征仍然难以解释,自动编码器也无法完全捕获原始模型的所有行为。此外,将特征的可解释性转化为对模型计算过程的理解,以及监控和控制模型行为,仍是需要进一步研究的课题。

OpenAI指出,这些新发现的特征有望在未来用于提高语言模型的监控和控制能力,并期待有一天可解释性能够为模型的安全性和稳健性提供新的推理方法,增强人们对新一代AI模型的信任。此外,机器之心发起了2024“人工智能+”标杆示范征集活动,旨在挖掘和展示具有市场竞争力和技术实力的AI机构、产品和案例,推动AI领域的健康发展。

原文和模型

【原文链接】 阅读原文 [ 2316字 | 10分钟 ]

【原文作者】 机器之心

【摘要模型】 glm-4

【摘要评分】 ★★★★★