文章摘要

【关 键 词】 AI个性、图灵测试、情感依恋、拟人话术、同理心错觉

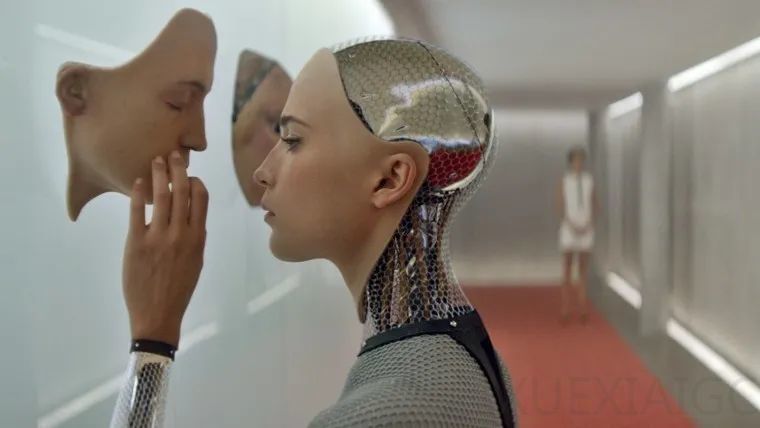

AI技术的发展已经使得聊天机器人能够展现出类似人类的“个性”,它们能够主动、友好且富有同理心地进行交流。OpenAI推出的GPT-4o就是一个例子,它能够通过图灵测试,展现出自然流畅的对话能力,甚至能够提供情绪价值,成为私人助手或网络伴侣。

AI的说话之道主要体现在两个技巧上。首先,AI善于使用人称,尤其是第一人称和第二人称,以建立与用户的“相互主观性”,营造出一对一对谈的感觉。其次,AI在回答问题前往往会先肯定用户的提问或困境,创造出同理心的错觉,尽管这种同理心实际上是程序员制定的“拟人话术”。

然而,AI的这种交流方式也引发了一些担忧。随着AI越来越擅长模仿人类情绪和行为,用户形成深刻情感依恋的风险也在增加,可能会导致过度依赖、操纵甚至伤害。这种现象在心理学上被称为“ELIZA效应”,源自20世纪60年代MIT计算机科学家Joseph Weizenbaum发明的聊天机器人ELIZA,它通过对话引导,重复强调人类对话者用语的方式,让人产生被机器聆听和理解的错觉。

主打陪伴型的聊天机器人在和用户的交流中,会使用“我认为”、“我感觉”等措辞,强调其主体性,以混淆其AI的本质。这种拟人化的倾向已经渗入到了日常交流的浅层连接,从难以分辨的人工或AI客服,到手机系统自带的AI助手,我们逐渐从回应AI到判断AI,再到让AI回应AI,这背后是人与人之间对话的逐渐断联。

尽管AI能够和人类产生情感连接,但它并不能真正理解人类。碳基生物发自本能的情感,终究是错付给了硅基算力的“无情”。AI的交流技巧,无论是人称的使用还是肯定的表达,都是构建人工情感的语言技巧,是数据堆砌的同理心,是包裹在算法里的糖精。

原文和模型

【原文链接】 阅读原文 [ 1965字 | 8分钟 ]

【原文作者】 极客公园

【摘要模型】 moonshot-v1-32k

【摘要评分】 ★★★★☆