文章摘要

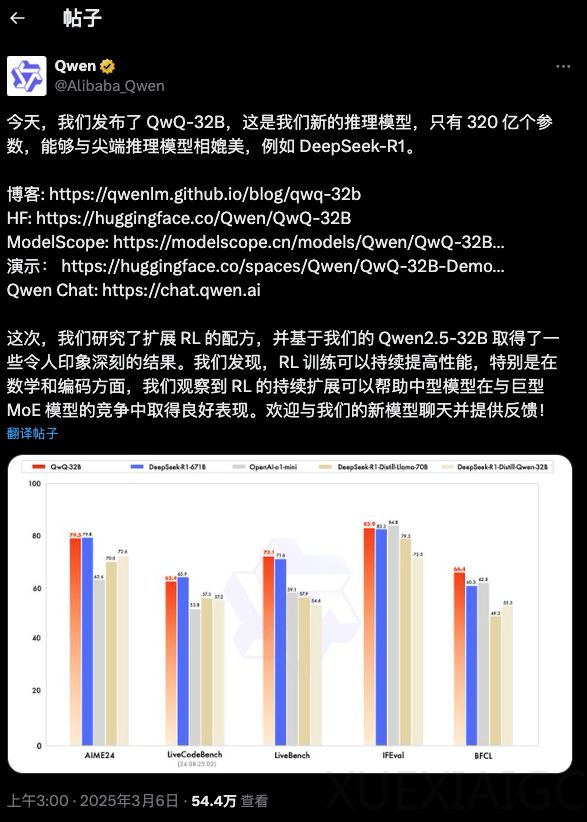

阿里在凌晨发布了全新的推理模型QwQ-32B,这一模型在多个数据集上的表现令人震惊,尤其是在数学和代码领域,其性能甚至能与DeepSeek R1(671B)相媲美。QwQ-32B在基准测试中的跑分显著优于其他模型,展示了其在推理能力上的强大优势。这一突破性成果不仅证明了强化学习技术仍有巨大的发展潜力,也为AI领域的研究者和开发者提供了新的思路和工具。

QwQ-32B在数学和代码领域的表现尤为突出,几乎能与满血版的DeepSeek R1(671B)相媲美。这一发现与近期在arXiv上发布的一篇论文相呼应,该论文探讨了Qwen-2.5-3B为何能够自我检查答案,而Llama-3.2-3B却无法做到。研究指出,Qwen团队采用的强化学习技术使得模型能够自主掌握一些关键的“思考习惯”,从而显著提升了其性能。

QwQ-32B的开源为开发者提供了极大的便利,用户可以通过魔搭和Huggingface平台轻松获取并部署该模型。此外,阿里还提供了在线体验的地址,用户可以直接在网页上使用QwQ-32B进行测试。本地部署与网页版的体验一致,进一步降低了使用门槛。

QwQ-32B在数学推理和代码生成方面的能力得到了充分验证。通过一系列测试,包括复杂的调休计算和LeetCode上的算法题,QwQ-32B均表现出了极高的准确性和效率。特别是在解数独的测试中,QwQ-32B生成的代码不仅通过了所有测试用例,执行用时仅为127ms,击败了93%的尝试者。这一结果展示了QwQ-32B在解决复杂问题上的强大能力。

QwQ-32B的开源不仅为AI领域注入了新的活力,也为中小型企业和开发者提供了强大的工具。与DeepSeek R1相比,QwQ-32B在算力需求和成本上具有显著优势,仅需4张4090显卡即可运行,大幅降低了部署门槛。这一突破使得更多企业和团队能够利用这一高性能模型进行创新和开发,无需依赖昂贵的硬件资源。

QwQ-32B的成功不仅证明了强化学习技术的潜力,也为开源社区带来了新的信心。它展示了中等规模模型同样能够达到高级性能,打破了人们对GPT4.5技术瓶颈的过度悲观。随着各大厂商和团队的不断努力,AI领域的新突破将层出不穷,QwQ-32B的发布无疑是这一进程中的重要里程碑。

原文和模型

【原文链接】 阅读原文 [ 1681字 | 7分钟 ]

【原文作者】 数字生命卡兹克

【摘要模型】 deepseek-v3

【摘要评分】 ★★★★☆