自有歪果仁为DeepSeek「辩经」:揭穿围绕DeepSeek的谣言

文章摘要

【关 键 词】 DeepSeek、AI模型、技术创新、训练成本、中美竞争

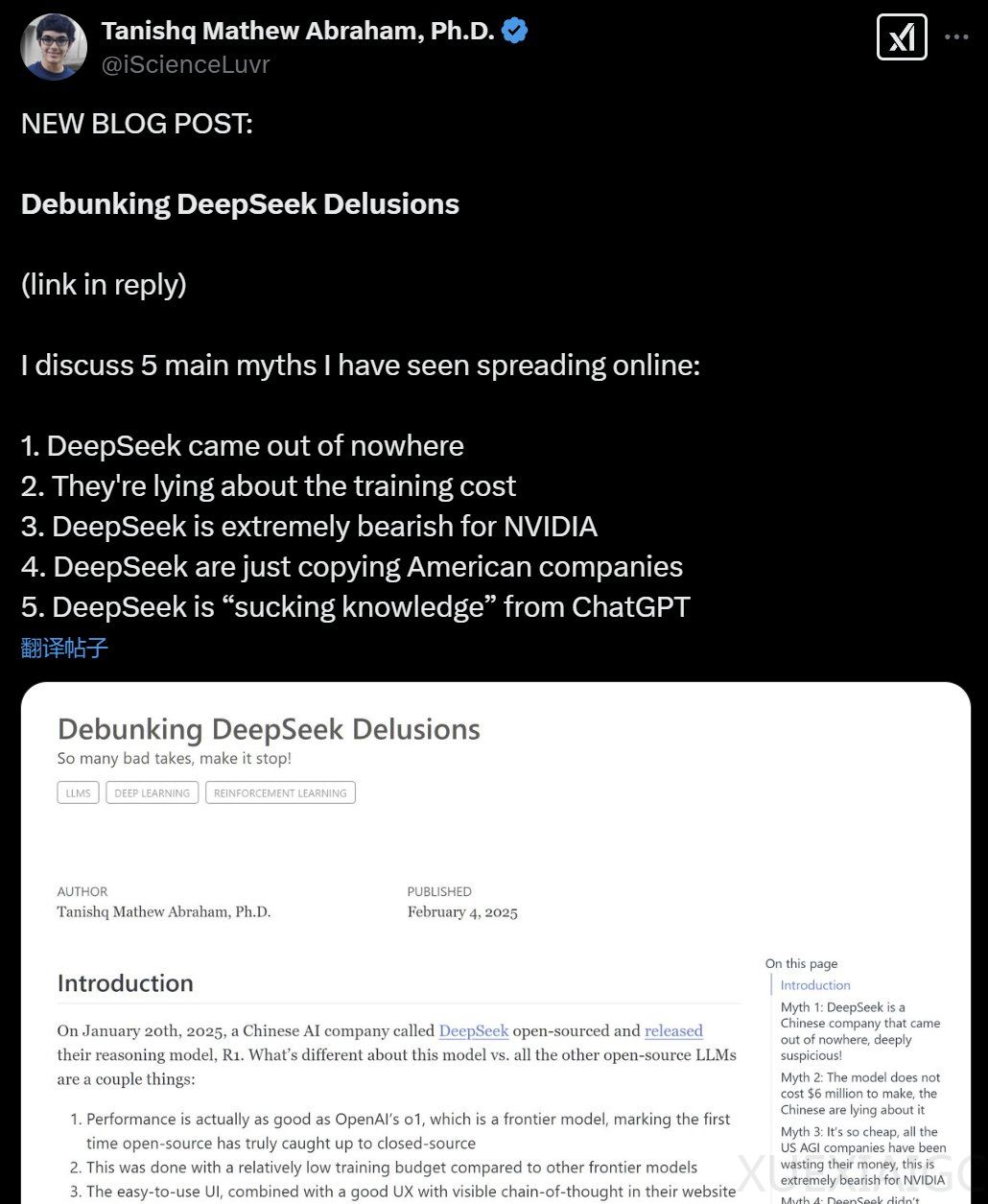

DeepSeek R1,一款由中国公司DeepSeek开发的先进大模型,因其开源和性能与OpenAI的o1相当而引发全球关注。该模型以其相对较低的训练预算、易用性和良好的用户体验获得认可,吸引了数百万新用户。然而,围绕DeepSeek的讨论中存在多个误解,包括对其公司背景、训练成本和技术创新的质疑。

首先,DeepSeek并非突然崛起的公司,其在AI领域已有显著进展,包括在2023年11月发布的DeepSeek-Coder模型。其次,关于训练成本,DeepSeek报告的600万美元基于市场GPU价格估算,实际成本可能更低,且包括了额外的实验和研究人员薪资等开销。此外,DeepSeek在训练效率上的表现优于许多其他大型语言模型(LLM),其成功不应被解读为对英伟达等公司的不利。

DeepSeek在语言模型设计和训练方式上展现了多项创新,包括Multi-latent注意力(MHA)、GRPO与可验证奖励以及DualPipe等。这些创新使得DeepSeek的模型在性能和效率上都有显著提升。关于DeepSeek从ChatGPT吸取知识的指控,缺乏证据支持,且DeepSeek的技术报告详细说明了其成就,不应被忽视。

尽管中国在AI领域取得了显著进展,但美国等国家的AI实验室仍保持领先地位。DeepSeek的成功不应被夸大或贬低,其R1模型的成就值得认可。在AI领域的竞争中,美国的AGI实验室前景依然光明,但中国的进展也不容忽视。

原文和模型

【原文链接】 阅读原文 [ 3816字 | 16分钟 ]

【原文作者】 机器之心

【摘要模型】 moonshot-v1-32k

【摘要评分】 ★★★☆☆

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...