文章摘要

【关 键 词】 大模型、中文教材、微调数据集、弱智吧、逻辑推理

在互联网时代,选择合适的中文教材对于训练大型语言模型至关重要。近期,一个研究团队在寻找高质量的中文指令微调数据集时,意外发现百度贴吧中的“弱智吧”竟然成为了训练大模型的优质语料库。这个子版块以其充满逻辑陷阱和哲学意味的内容而著称,这些内容对于提升模型的逻辑推理能力似乎有着意想不到的效果。

研究团队发表的论文《COIG-CQIA: Quality is All You Need for Chinese Instruction Fine-tuning》提出了一个中文指令微调数据集COIG-CQIA,旨在构建一个多样化、广泛的服务于中文大模型的指令调优数据集。这个数据集的目的是使模型的行为在中文环境下与人类互动更加一致,并提高指令响应的能力。指令微调是为了让模型能够处理特定问题而进行的调整,它需要明确的指令-输出对,即用户希望模型执行的任务说明和模型应生成的理想输出。

为了构建这个数据集,研究团队从不同的社交平台收集了高质量的人工编写文本,并进行了严格的筛选和处理。他们去除了无关或低质量的文本,并进行了人工审核,确保文本内容正确无误,符合预期的语义和知识标准。特别是对于像弱智吧这样的数据,由于其含义深层且难以被模型完全理解,研究团队进行了人工标注,提供了明确的指令-输出示例。

使用COIG-CQIA数据集对多个开源中文大模型进行微调后,研究团队发现,基于弱智吧数据训练的模型在多个领域的性能评估中表现出色,甚至在安全性能测试中也超过了GPT 3.5。这表明弱智吧的数据不仅能够增强模型的逻辑推理能力,还具备一定的商业化潜力。

论文作者对弱智吧数据集的出色表现感到惊讶,并分析认为这可能是因为其数据特性有助于增强模型的逻辑推理能力。而弱智吧中充满智慧和幽默的内容,如脑筋急转弯式的问答,确实为大语言模型提供了极好的训练语料。这些内容不仅挑战了模型的逻辑能力,也为人工智能的发展提供了新的思路。

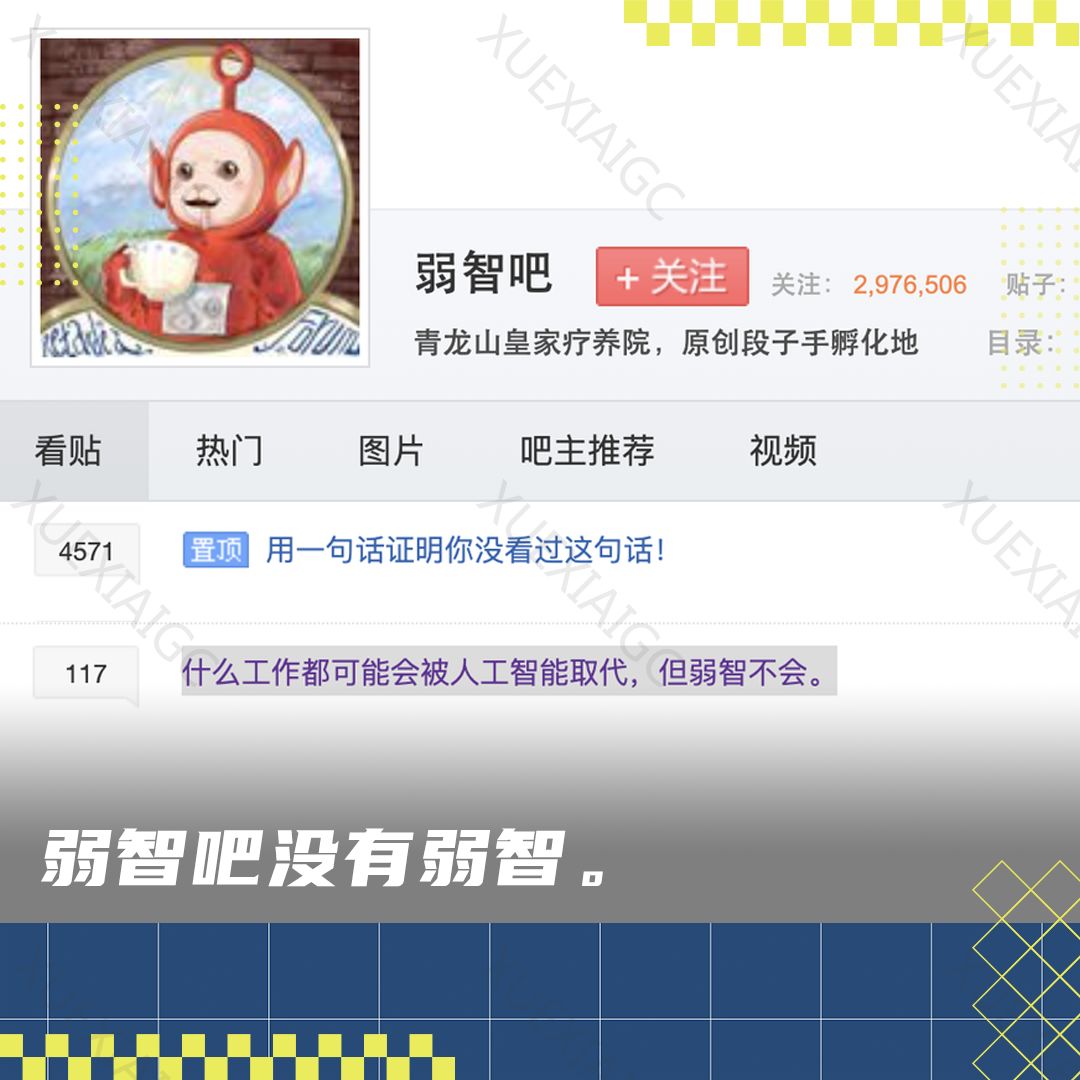

最后,作者通过查看弱智吧的经典语录,进一步确认了这些内容对于提升大模型逻辑能力的潜力。同时,弱智吧的一个热门帖子也巧妙地指出了人工智能可能取代许多工作,但弱智的创造力和独特性是不可替代的。这篇文章以一种幽默的方式结束,提醒我们即使在人工智能高速发展的时代,人类独有的创造力和思维方式仍然具有不可估量的价值。

原文和模型

【原文链接】 阅读原文 [ 1775字 | 8分钟 ]

【原文作者】 硅星人Pro

【摘要模型】 gpt-4

【摘要评分】 ★★★★☆