文章摘要

【关 键 词】 模型合并、进化算法、基础模型、性能提升、潜力挑战

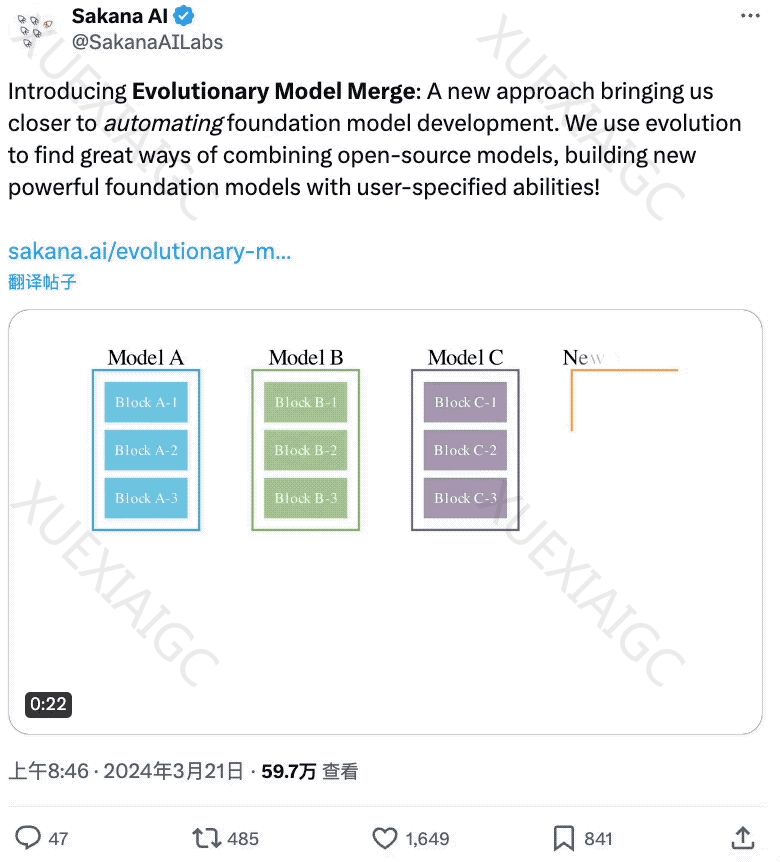

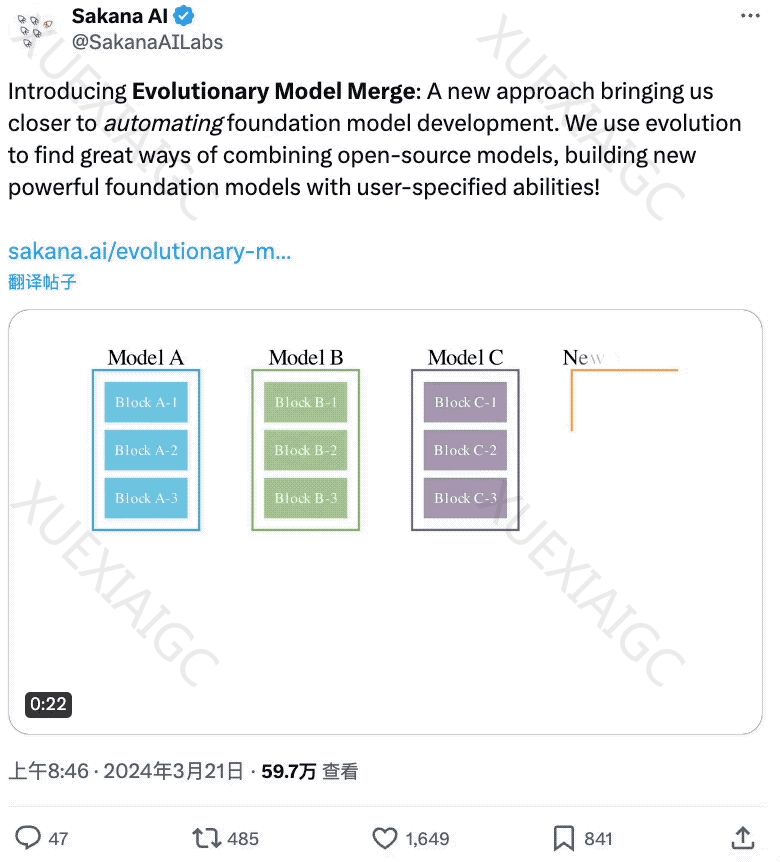

这篇文章介绍了日本大模型公司

原文和模型

【原文链接】 阅读原文 [ 1524字 | 7分钟 ]

【原文作者】 量子位

【摘要模型】 gpt-3.5-turbo-0125

【摘要评分】 ★☆☆☆☆

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...

【关 键 词】 模型合并、进化算法、基础模型、性能提升、潜力挑战

这篇文章介绍了日本大模型公司

【原文链接】 阅读原文 [ 1524字 | 7分钟 ]

【原文作者】 量子位

【摘要模型】 gpt-3.5-turbo-0125

【摘要评分】 ★☆☆☆☆