文章摘要

【关 键 词】 AI编程、开源模型、性能领先、多语言支持、全球领先

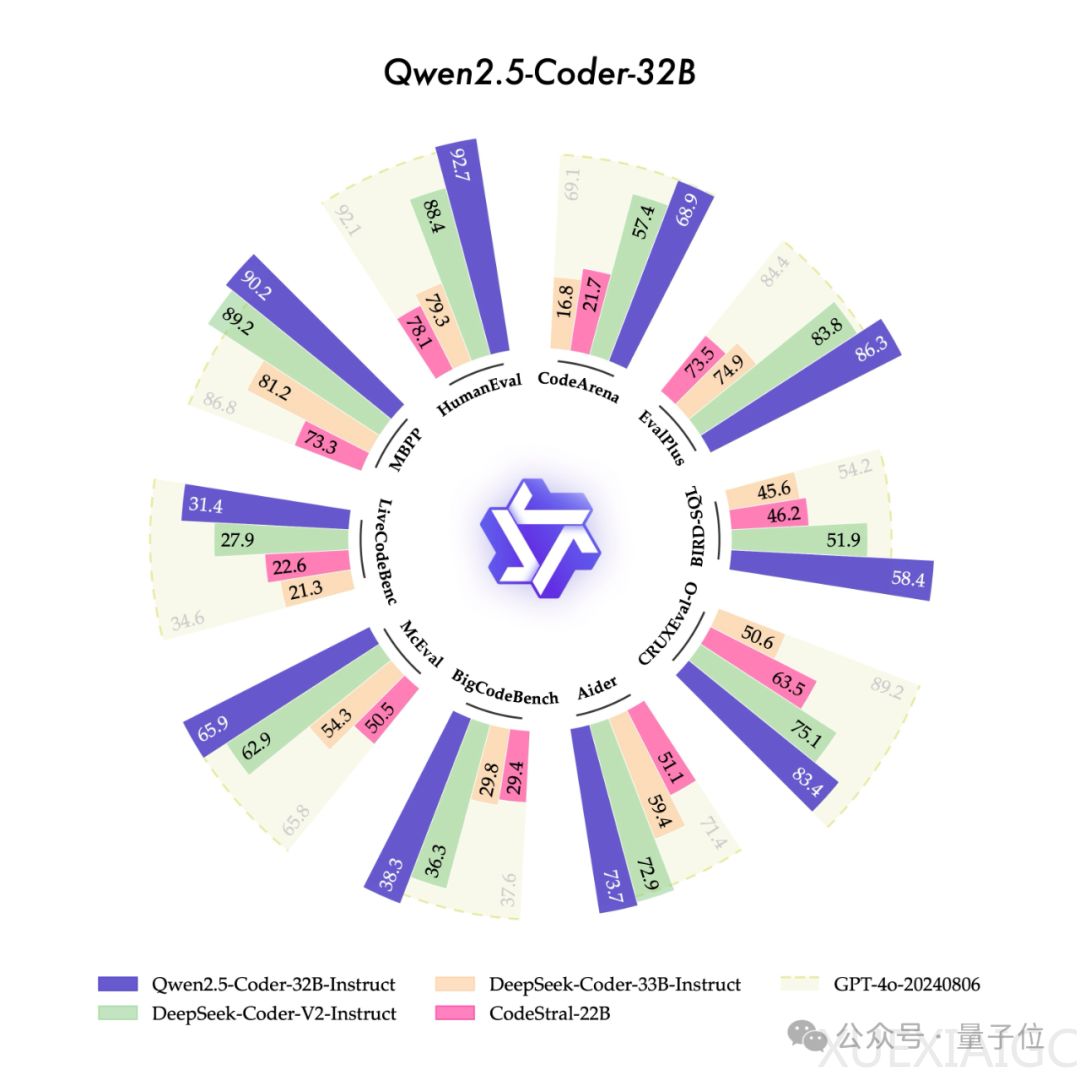

Qwen2.5-Coder-32B,一款AI编程模型,已在多个主流基准测试中取得最佳成绩(SOTA),超越了闭源编程模型GPT-4o,成为全球最强开源编程模型。该模型在12个代码能力基准上与GPT-4o对决,赢得9场胜利。用户只需提供详细的自然语言提示,Qwen2.5-Coder-32B就能生成完整的代码,使得编程新手也能轻松上手。

Qwen2.5-Coder系列此次开源了0.5B、1.5B、3B、7B、14B和32B共6个尺寸的模型,每个尺寸都达到了同等规模下的SOTA性能,并且大部分版本采用宽松的Apache 2.0许可。自CodeQwen1.5推出以来,该系列模型就成为开发者社区关注的焦点。Qwen2.5-Coder-7B版本发布后,被认为可以替代GPT-4和Sonnet 3.5成为日常主力工具。

Qwen2.5-Coder基于Qwen2.5基础大模型,使用混合数据进行训练,提升了代码生成、推理和修复等核心任务的性能。新发布的全系列模型包含base和Instruct两个版本,其中Instruct模型可以直接进行聊天交互。Qwen2.5-Coder-32B-Instruct作为旗舰模型,在代码生成、修复、推理、多语言支持和人类偏好对齐等方面超越了GPT-4o。

Qwen2.5-Coder-32B-Instruct支持92种编程语言,并在多种语言上表现出色。在多语言代码修复基准MdEval上,它取得了75.2分,位列所有开源模型第一。此外,Qwen2.5-Coder-32B-Instruct在人类偏好对齐方面与闭源模型相当,胜率为68.9%。

Qwen2.5-Coder的推出受到了全球开发者的追捧,基于该模型的应用层出不穷,如Qwen Code Interpreter和专门用于Rust语言的编程助手。Qwen系列已成为全球最大的生成式语言模型族群,全球基于Qwen系列二次开发的衍生模型数量已突破7.43万。Qwen作为中国开源大模型的领军者,为全球开发者提供了丰富的选择,并在全球大模型竞技中崭露头角。据悉,Qwen3也即将发布。

原文和模型

【原文链接】 阅读原文 [ 2383字 | 10分钟 ]

【原文作者】 量子位

【摘要模型】 moonshot-v1-32k

【摘要评分】 ★★★★☆