文章摘要

【关 键 词】 AI视频生成、PixelDance、音乐视频、豆包模型、同声传译

字节跳动公司近期推出了一系列先进的AI视频生成模型,包括PixelDance和Seaweed模型,这些模型因其出色的效果而受到广泛关注。为了测试这些模型的能力,作者尝试使用这些AI工具制作了一部《红楼梦》主题的音乐视频。

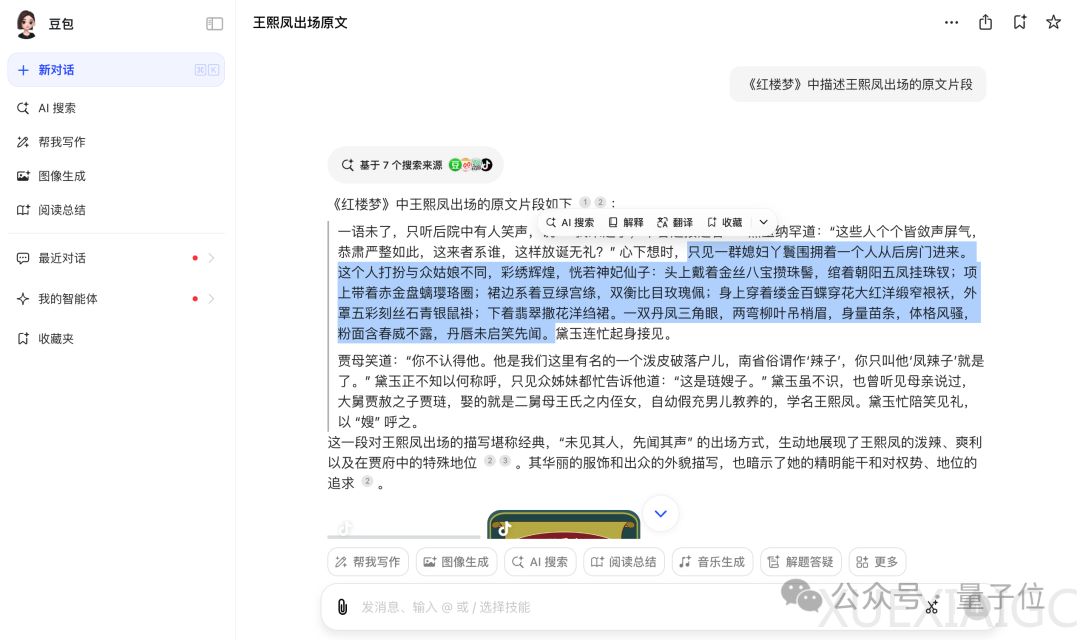

制作过程中,首先利用豆包查询《红楼梦》中的经典片段作为生成图片的提示(Prompt),然后使用即梦模型生成画作。接着,将生成的图片输入PixelDance模型,并提供相应的动作提示来生成视频片段。此外,还使用了海绵音乐模型根据简单的情感描述生成背景音乐,最后通过剪映进行视频剪辑。

PixelDance模型展现出了四个关键能力:精准的语义理解,能够处理多动作和多主体交互;强大的动态效果和炫酷的运镜技术;在多镜头生成中保持一致性;以及支持多种风格和比例。这些能力使得生成的视频在质量上达到了影视级别。

除了视频模型,字节跳动还发布了豆包音乐模型和同声传译模型,后者能够实时翻译并保持高准确性和自然度。此外,豆包通用模型也得到了显著提升。

豆包大模型家族的日均tokens使用量已经超过1.3万亿,显示出广泛的应用和接受度。字节跳动采取了“先To C,再To B”的策略,即先在消费者层面达到极致效果,再将模型应用于商业领域。随着大模型价格的下降,创新的成本障碍正在降低。

文章最后提到,字节跳动的AI技术不仅限于视频生成,还包括音乐创作和同声传译等多个领域,展现了公司在AI领域的全面进步和潜力。

原文和模型

【原文链接】 阅读原文 [ 4549字 | 19分钟 ]

【原文作者】 量子位

【摘要模型】 moonshot-v1-32k

【摘要评分】 ★★★★☆

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...