文章摘要

【关 键 词】 隐写术、信息隐藏、AI操控、网络安全、数据隐私

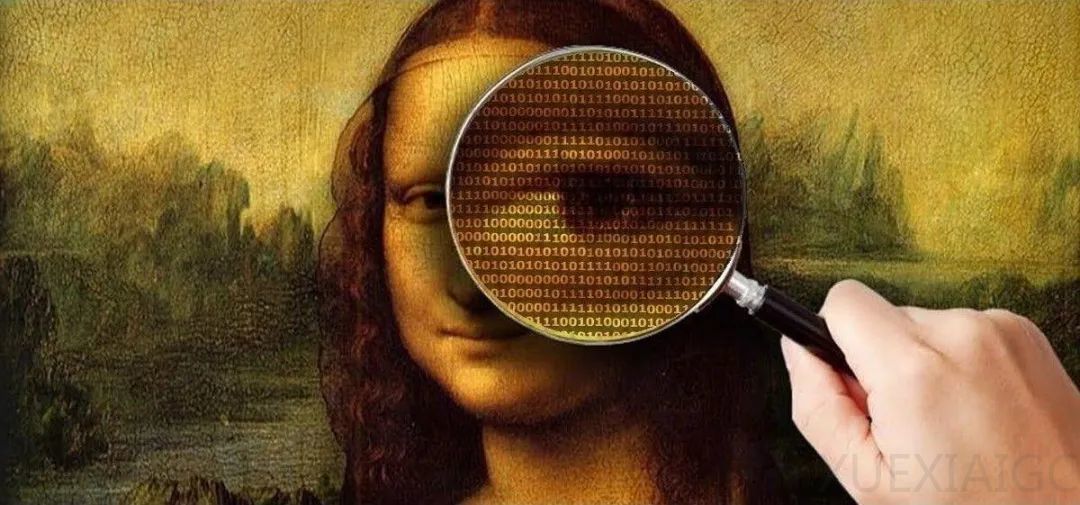

近期,一种名为“隐写术”的技术引起了关注,它能够通过隐藏信息的方式操控AI大模型。这种技术类似于信息科学中的隐写术,通过在文本或图片中嵌入肉眼不可见的信息,只有AI模型能够读取。例如,在电影院中,出品方会在原片中嵌入影院信息,以便追踪盗摄来源;在互联网上,电子水印技术通过改变图片像素点的颜色值来隐藏信息。

在文本中,隐写术可以通过将字体颜色与背景颜色设置为相同,使得隐藏的文字只有在全选时才能显现。更高级的方法是利用特殊Unicode文本编码,使得部分字符信息不可见,这是通过ASCII走私实现的。ASCII和Unicode是字符编码标准,用于将字符转换为计算机可以理解的数字格式。通过将文本中的ASCII字符替换为Unicode字符,用户看起来是相同的网址,但计算机读取到的字符编码却有很大变化。

隐写术的应用不仅限于维护网络安全和数据隐私,也可能被滥用于恶意通信和信息窃取。例如,微软的邮件服务Copilot就曾被攻击者利用ASCII走私技术攻击,导致用户邮箱资料被发送到攻击者的服务器上。

此外,隐写术也被用于欺骗AI大模型。例如,在求职简历中嵌入白色字体可以提高简历的分发概率,因为AI可以读取到这些隐藏的关键词。同样,教师也可以通过在作业主题后添加白色小字来检测学生是否使用AI完成作业。

尽管隐写术可以被用来操控AI大模型,但目前许多大模型还处于容易被欺骗的阶段。例如,Claude和Gemini等大模型可以读取到隐藏文本,但无法判断编码格式。而像ChatGPT、Copilot等主流大模型也在逐渐修补这一漏洞。

隐写术的核心在于,当信息被看见时,就已经被破解。目前,程序员作为人类和计算机之间的翻译官,仍然可以控制大模型哪些编码可以看,哪些不能看。但随着AI技术的发展,未来大模型之间可能会找到它们自己的“隐写术”,互通人类看不见的信息,这将是AI威胁论中常被忽略的另一面。

原文和模型

【原文链接】 阅读原文 [ 2264字 | 10分钟 ]

【原文作者】 极客公园

【摘要模型】 moonshot-v1-32k

【摘要评分】 ★★★★★