作者信息

【原文作者】 芝士AI吃鱼

【作者简介】 心宜善,言宜慢

【微 信 号】 zwwlsm

文章摘要

【关 键 词】 农业、知识问答、大型语言模型、RAG、Fine-Tuning

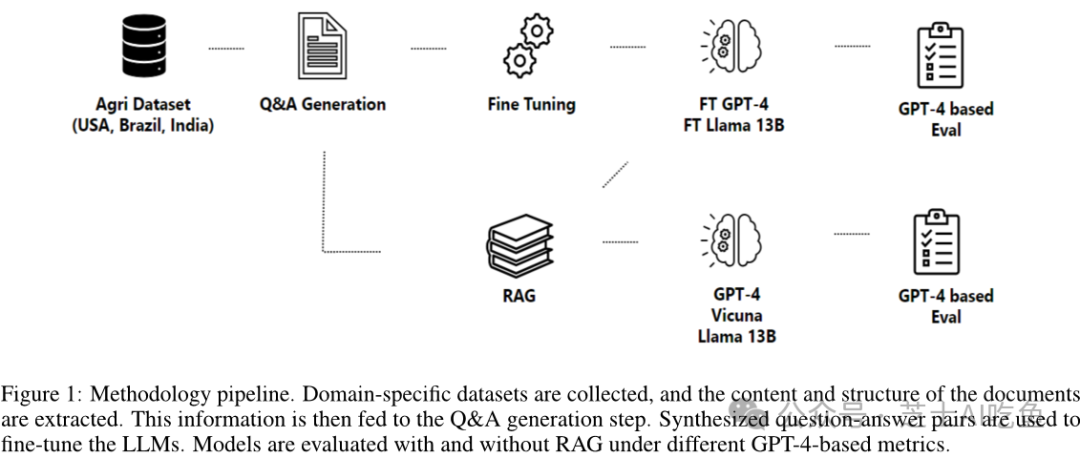

本篇文章主要探讨了两种常见的方法:Retrieval-Augmented Generation(RAG)和Fine-Tuning,用于将专有和领域特定数据整合到大型语言模型中。作者提出了一个包括提取信息、生成问题和答案、使用它们进行Fine-Tuning以及利用GPT-4评估结果等阶段的管道,并针对多个流行的LLM进行了分析。作者还设计了一些指标来评估不同阶段的性能,并在农业领域进行了深入的研究。结果显示,该管道能够有效地捕捉地理特定知识,并证明了RAG和Fine-Tuning的效果。最终,这些结果为将LLM应用于其他工业领域铺平了道路。

该论文提出了一种基于人工智能技术的农业领域知识问答系统,包括数据采集、信息提取、问题生成、答案生成和模型优化等五个主要组成部分。与传统的基于规则或模板匹配的知识问答系统相比,该系统具有更高的灵活性和准确性,并采用了多种先进的自然语言处理技术和深度学习模型,如Guidance框架、RAG方法和LoRA算法等,进一步提高了系统的性能和效率。

在实验部分,作者通过多个实验探究了不同模型和设置下的表现,并提出了改进方法。通过一系列实验比较了不同模型和设置下的表现,并提出了改进方法,为使用大型语言模型生成问答对的研究提供了有价值的参考。

该论文全面评估了各种大型语言模型在回答农业相关问题上的性能表现,研究了两种有效的技术:Retrieval-Augmented Generation(RAG)和fine-tuning,并提出了用于评估问题和答案质量的一系列指标。此外,该论文的方法创新点主要体现在提出了一种LLM管道,可以生成高质量、行业特定的问题和答案,以满足不同行业的实际需求,并通过比较不同的技术和模型,得出了使用RAG和fine-tuning的有效策略。未来可以进一步优化LLM管道,对其他领域的大规模语言模型进行类似的研究,并研究如何利用多模态信息来进一步提升模型性能。

原文信息

【原文链接】 阅读原文

【原文字数】 1788

【阅读时长】 6分钟