文章摘要

【关 键 词】 AI游戏开发、视觉AI助理、图像分析、模型微调、游戏市场

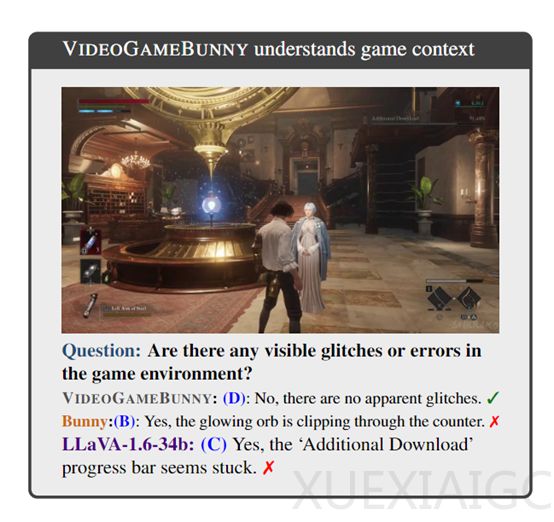

加拿大阿尔伯塔的研究人员开发了一款名为VideoGameBunny(VGB)的大模型,旨在提升游戏开发领域的AI应用。VGB作为一款视觉AI助理,能够理解游戏环境并提供实时反馈,增强游戏的互动性和沉浸感。它通过分析游戏图像数据,帮助开发人员识别和修复bug,提高游戏质量。

VGB基于Bunny模型,采用多层感知器网络和强预训练视觉模型,将视觉嵌入转化为图像标记,供语言模型处理。这一设计方法类似于LLaVA,能够高效协同处理数据。Bunny模型支持高达1152×1152像素的图像分辨率,有助于捕捉游戏中不同尺寸的视觉元素,提高内容理解能力。

为了提升VGB对游戏视觉内容的理解,研究人员结合了Meta的LLama-3-8B语言模型、SigLIP视觉编码器和S2包装器。这些技术能够捕捉游戏中不同尺度的视觉元素,提供丰富的上下文信息。此外,VGB还使用了Gemini-1.0-Pro-Vision、GPT-4V、GPT-4o等模型生成指令数据,以更好地理解和响应玩家的查询和命令。

在训练方面,VGB采用了LoRA参数高效微调方法,保持预训练权重的同时对特定任务进行微调,提高模型性能。研究团队还使用了PEFT库指导训练过程,提升训练效率和稳定性。训练数据包括来自413款游戏的185,000多张图像和39万个图像-指令对,涵盖图像说明、问答对和136,974张图像的JSON表示。

JSON格式的数据包含16个元素,捕捉图像的多层次细节信息,如整体概述、人物描述、天气信息、用户界面和玩家库存摘要、场景物体、照明和环境效果等。研究团队使用Gemini-1.5-Pro结合特定指示,将图像转换成具有层次结构细节和信息的JSON文件。

VGB的开发旨在满足全球游戏市场对大模型的需求,辅助开发人员和玩家在游戏开发、性能测试和提升游戏体验等方面。随着游戏市场的持续增长,VGB有望在游戏领域发挥重要作用。

原文和模型

【原文链接】 阅读原文 [ 1057字 | 5分钟 ]

【原文作者】 AIGC开放社区

【摘要模型】 moonshot-v1-32k

【摘要评分】 ★★☆☆☆