文章摘要

【关 键 词】 战略规划、AI融合、资源分配、产品转型、LLMOps

在构建大型语言模型(LLM)应用程序的过程中,Eugene Yan 及其团队分享了一系列战略和战术见解。他们指出,战略是解决“什么”和“为什么”的问题,而战术和运营则是“如何”实现这些目标的具体行动和高层次过程。本文将深入探讨如何高效地分配资源、创造长期竞争优势、将AI融入人类工作流程、以及从演示到产品的转变。

首先,团队需要决定是自行训练模型还是使用现成的API。这取决于多种因素,包括产品市场契合度和资源可用性。在产品市场契合之前,避免使用GPU,因为投入模型训练可能分散构建实际产品的精力和资源。对于大多数组织来说,从头开始训练大模型是不切实际的,团队应考虑对开源模型进行微调以满足特定需求。

在构建系统而非模型的理念下,团队应专注于提供令人难忘的体验,而不仅仅是追求最新的模型。以人为中心的AI强调了构建支持和增强人类能力的AI工具的重要性,而不是试图完全取代人类。入门指南建议从提示词工程、评估和数据收集开始,避免过早引入复杂性。

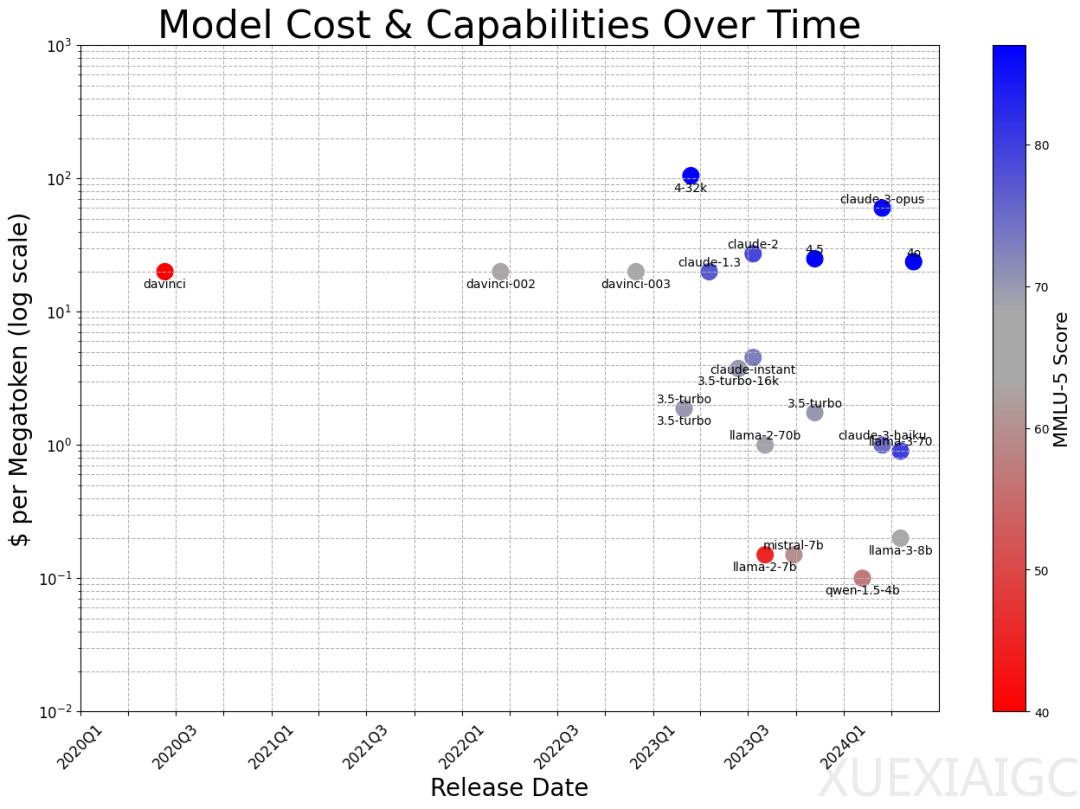

低成本认知的未来将由大模型的成本降低和能力增强所塑造。历史趋势表明,大模型的成本正在迅速降低,能力在增加,这将影响AI应用的未来。从演示到产品的转变需要严格的工程、测试和持续改进,以缩小原型和生产之间的差距。

战略上,成功的产品需要深思熟虑的规划和严格的优先级安排。团队在开发过程中可能面临的主要权衡问题包括决定是自主构建还是外部采购。在产品契合市场之前不要使用GPU,因为急于投入模型训练可能是一个错误。从头开始训练模型对于大多数组织来说是一种不切实际的分心。

以BloombergGPT为例,尽管付出了巨大的努力,但在金融任务上的表现很快被其他模型超越。这表明,在领域特定数据上从头开始预训练大模型并不是资源的最佳利用方式。相反,团队应该考虑对可能满足他们特定需求的最强大的开源模型进行微调。

微调应在证明必要性之前不要进行,因为微调是一项重装备操作,只有在收集了大量示例并确信其他方法均不足以解决问题时才考虑使用。从推理API开始,但不要拒绝自托管,因为自托管能够避开供应商可能设置的限制,并在大规模应用中显著降低成本。

迭代至卓越需要超越模型,想想是什么让你的产品脱颖而出。模型不是产品,围绕它的系统才是。专注于那些能够提供长期价值的东西,例如评估基线、安全护栏、缓存策略和数据飞轮。建立信任,从小处开始,专注于特定领域和用例,以开发出与用户产生共鸣的专业工具。

打造LLMOps是为了更快的迭代,关注缩短工作流与结果反馈之间的周期,从而促进持续改进。如果可以买,就不要自己构建,因为大多数成功的业务并不是基于大语言模型的业务,但大多数业务都存在通过大模型进行改进的可能性。

AI辅助,以人为本,将人类置于核心位置,并探索如何让大模型来辅助他们的工作流。从提示词、评估和数据收集开始,保持简单,只在必要时才引入复杂性。评估并启用数据飞轮,通过构建随时间增值的资产,将评估工作从单纯的运营成本转变为战略投入。

低成本趋势表明,在成本固定之下,能力正迅猛提升。在能力水平固定之下,成本正急剧下降。这些趋势虽然还很新,但我们没有理由认为它们在未来几年会有所减缓。从0到1已经够多了,是时候从1到N了,构建大模型演示应用非常有趣,但演示中的完美表现与大规模稳定运行的产品之间存在着巨大的差异。

总之,构建大型语言模型应用程序需要深思熟虑的战略规划和严格的优先级安排。团队应该专注于创造长期竞争优势,将AI融入人类工作流程,并从演示到产品的转变。通过遵循这些战略和战术见解,团队可以更有效地分配资源,构建卓越的AI产品。

原文和模型

【原文链接】 阅读原文 [ 7129字 | 29分钟 ]

【原文作者】 AI前线

【摘要模型】 moonshot-v1-32k

【摘要评分】 ★★★★☆