Windsurf团队科普Agent:不是什么都叫智能体!

文章摘要

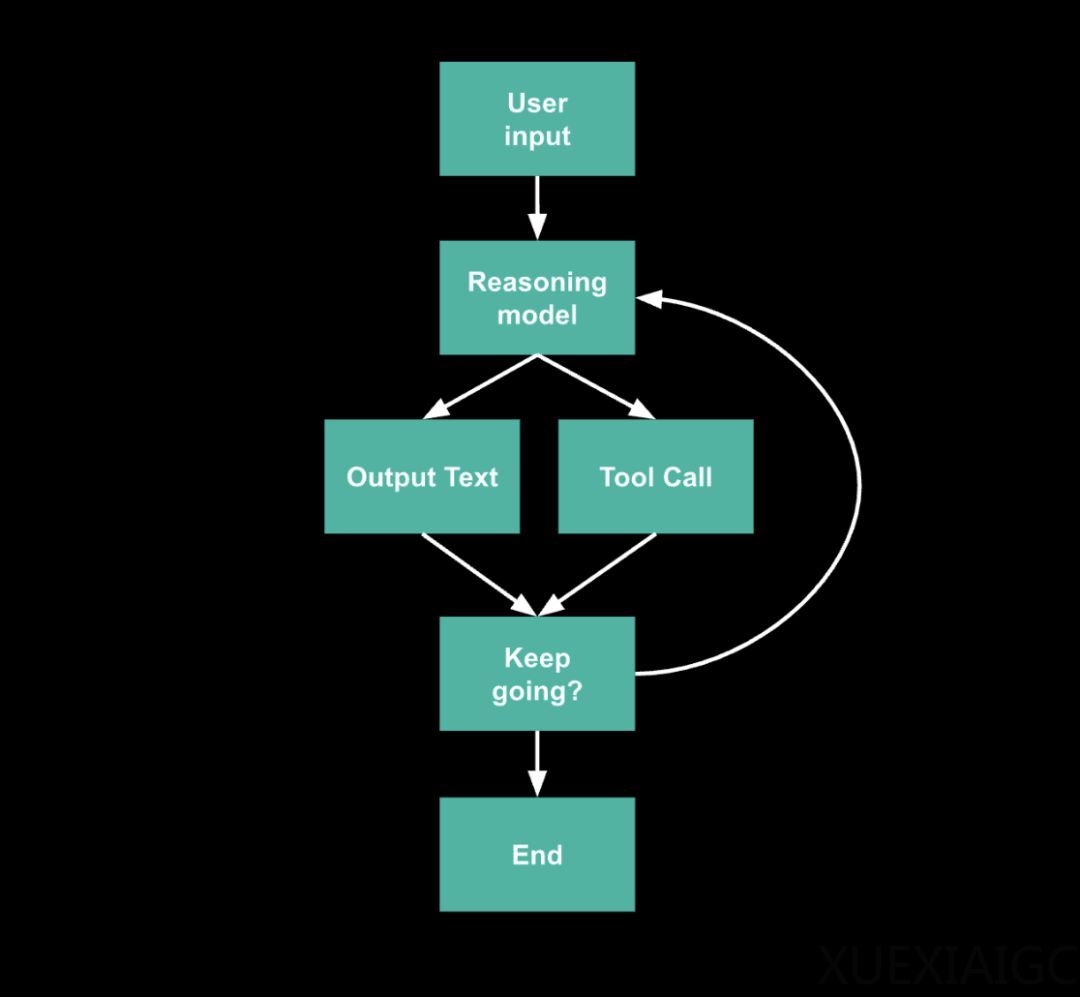

Agent系统的核心概念可以简单理解为“LLM+工具”的循环。Agent系统通过接收用户输入,交替调用推理模型(LLM)和工具来完成任务。 推理模型负责决定下一步行动,并输出结构化信息,指定调用哪个工具及其参数。工具则执行推理模型指定的行动,并将结果反馈给推理模型,形成一个循环。这种设计使得LLM不仅仅是内容生成器,而是更像一个负责选择工具的推理组件。 推理在Agent领域特指利用LLM决定下一步行动,而非其他语境下的思维链推理。

Agent系统与非Agent系统的区别在于,前者允许LLM在运行时自行决定调用哪些工具,而后者则是在工作流中预先规定好LLM的调用顺序和方式。Agent系统的优势在于能够将复杂任务分解为多个步骤,类似于人类处理问题的方式,并且通过使用人类熟悉的工具,降低了结果的不确定性。 此外,Agent系统可以通过工具弥补LLM的不足,例如添加计算器、系统时间或构建工具等,使得LLM无需掌握所有领域的知识,只需知道何时调用相应工具即可。

协作式Agent(collaborative agents)是当前Agent系统的一个重要发展方向。协作式Agent强调人类与Agent之间的平衡,允许用户在工作流执行过程中观察进展并及时纠正偏差。 这种方法所需的可靠性门槛显著低于自主Agent,因为人类可以在中间步骤进行干预和审查。目前,所有能为用户带来切实价值且普通用户可接触到的Agent应用,都采用了这种方法。 例如,Windsurf的Cascade、Cursor的Composer Agent和GitHub Copilot Workspaces等系统,都在人类和Agent协同运作的环境中运行。

在构建Agent系统时,开发者需要关注几个关键问题:系统是否真正符合Agent的定义,是自主的还是协作式的,Agent可以访问哪些工具,使用的推理模型是什么,如何处理现有数据,以及如何捕捉用户意图。 此外,用户体验也是决定Agent系统成功与否的重要因素,包括系统的延迟、用户如何观察和引导Agent、Agent如何集成到应用中,以及如何平衡Agent体验与非Agent体验。

最后,构建Agent系统时需要注意“苦涩的教训”,即避免过度依赖人类定义的结构或规则。随着模型持续改进和计算能力增强,这些努力可能会被更强大的技术所超越。 因此,开发者应避免陷入过度设计的陷阱,保持对技术发展趋势的敏感性。

总之,Agent系统通过结合LLM和工具,能够更灵活地处理复杂任务,而协作式Agent则进一步提升了系统的可靠性和用户体验。 未来,随着技术的进步,Agent系统有望在更多领域发挥重要作用。

原文和模型

【原文链接】 阅读原文 [ 5992字 | 24分钟 ]

【原文作者】 Founder Park

【摘要模型】 deepseek-v3

【摘要评分】 ★★★★★