Stability AI开源3B代码生成模型:可补全,还能Debug

文章摘要

【关 键 词】 预训练、代码生成、性能评估、编码任务、效率提升

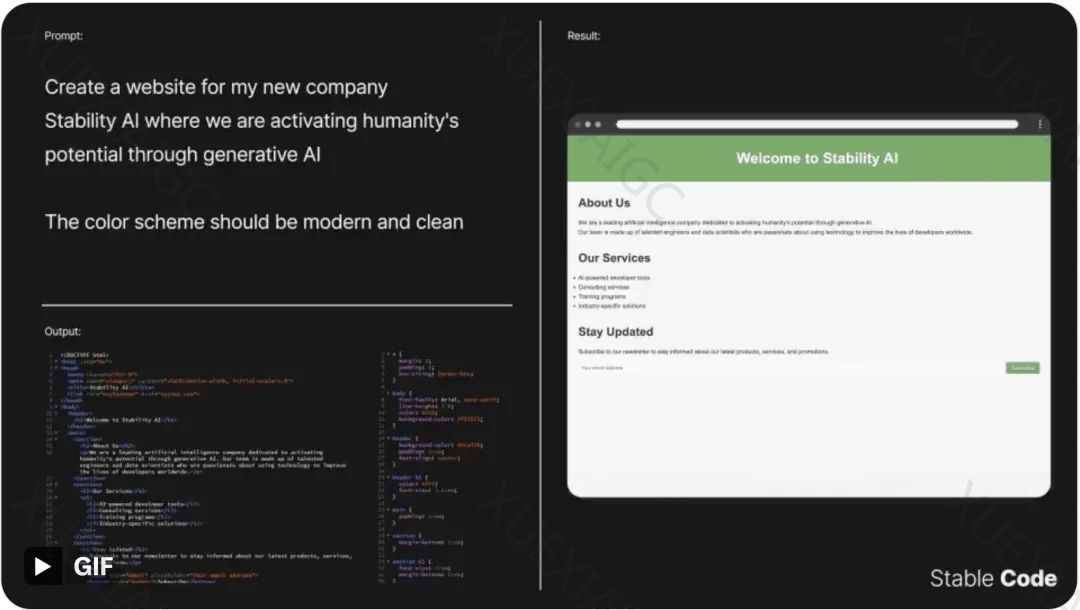

本文报道了Stability AI 公司开源的小体量预训练模型 Stable Code Instruct 3B,该模型是一个基于 Stable Code 3B 的指令调整编码语言模型,能够处理各种任务,包括代码生成、数学和其他软件工程相关任务。Stability AI 宣称该模型在 3B 规模上提供了 SOTA 性能,并且在软件工程相关任务中优于其他更大规模的模型。Stable Code Instruct 3B增强了代码补全能力,支持自然语言交互,旨在提高编程和软件开发任务的效率和直观性。该模型在实验测试中表现优异,超越了其他同类模型。

Stable Code 是建立在 Stable LM 3B 基础上的因果纯解码器 transformer,与 LLaMA 架构有一些区别,包括位置嵌入、标准化和偏差等方面。该模型重点关注流行的编程语言如Python、Javascript、Java、C、C++ 和 Go,并且也针对其他广泛采用的语言进行了训练。即使对于最初未包含在训练集中的语言,如Lua,Stable Code Instruct 3B也展现出强大的测试性能,这可能源于其对底层编码原理的理解和适应概念的能力。

Stable Code Instruct 3B不仅擅长代码生成,还能处理FIM任务、数据库查询、代码翻译、解释和创建等广泛的编码任务,包括数学理解、逻辑推理和处理复杂的技术描述。在性能评估方面,该模型在一系列编码任务中表现出卓越的性能,与其他领先模型相比展现出优势。研究团队还在Multi-PL基准上比较了三种模型,结果显示Stable Code Instruct 3B在所有语言上的表现均明显优于其他模型。

总体而言,Stable Code Instruct 3B的参数规模小、硬件要求低,适合广泛的受众使用,能够帮助开发人员更高效地工作。该模型现在可以通过Stability AI会员资格用于商业目的。

原文和模型

【原文链接】 阅读原文 [ 917字 | 4分钟 ]

【原文作者】 机器之心

【摘要模型】 gpt-3.5-turbo-0125

【摘要评分】 ★★★★☆