文章摘要

【关 键 词】 AI风险、技术警告、保密限制、监管呼吁、责任意识

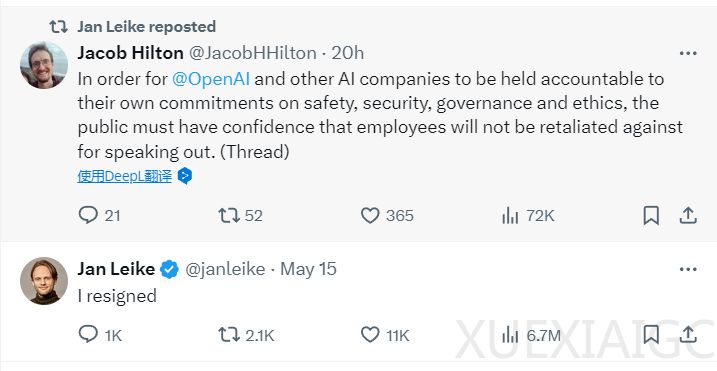

来自OpenAI和Google DeepMind的13名现任及前员工联名发出一封公开信,表达了对人工智能技术发展可能带来的风险隐患的担忧。他们认为,作为对公众负有责任的技术人员,他们应获得向公众发出警告的权利,并呼吁免除因言论遭受的报复风险。

这些员工指责现有的保密协议限制了他们对技术潜在风险的讨论,指出这种保密文化可能导致严重的后果,如加剧社会不平等、信息操纵、失去对AI系统的控制,甚至可能导致人类灭绝。他们强调了制定相应监管措施的重要性,因为当前和前任员工是少数能够监督这些公司对公众负责的人。

公开信提出了四项原则以争取员工的“警告权”:首先,公司不得签订或执行任何禁止因风险相关担忧而批评公司的协议;其次,公司应为员工提供可验证的匿名程序,让他们向监管机构提出担忧;第三,公司应支持开放批评的文化;最后,公司不应报复那些在无其他发声渠道时向公众分享风险信息的员工。公开信提出了四项原则以争取员工的“警告权”。

联名信中,7人实名公开,他们的行动突显了对AI安全问题的责任感和对公众福祉的追求。7人实名公开,他们的行动突显了对AI安全问题的责任感和对公众福祉的追求。

OpenAI方面回应称,公司对提供安全和有能力的AI系统的记录感到自豪,并承认在严格辩论中交流的重要性。OpenAI方面回应称,公司对提供安全和有能力的AI系统的记录感到自豪,并承认在严格辩论中交流的重要性。联名信的发起人们则强调,即使公司内部有辩论,但员工仍可能因担忧报复而选择沉默,因此呼吁建立保护员工免受不当报复的机制。联名信的发起人们则强调,即使公司内部有辩论,但员工仍可能因担忧报复而选择沉默,因此呼吁建立保护员工免受不当报复的机制。

原文和模型

【原文链接】 阅读原文 [ 4065字 | 17分钟 ]

【原文作者】 51CTO技术栈

【摘要模型】 glm-4

【摘要评分】 ★★★★★