OpenAI华人科学家翁荔:人类如何培养出下一代聪明且安全的AI技术|钛媒体AGI

文章摘要

【关 键 词】 AI安全、数据偏见、强化学习、道德准则、社区参与

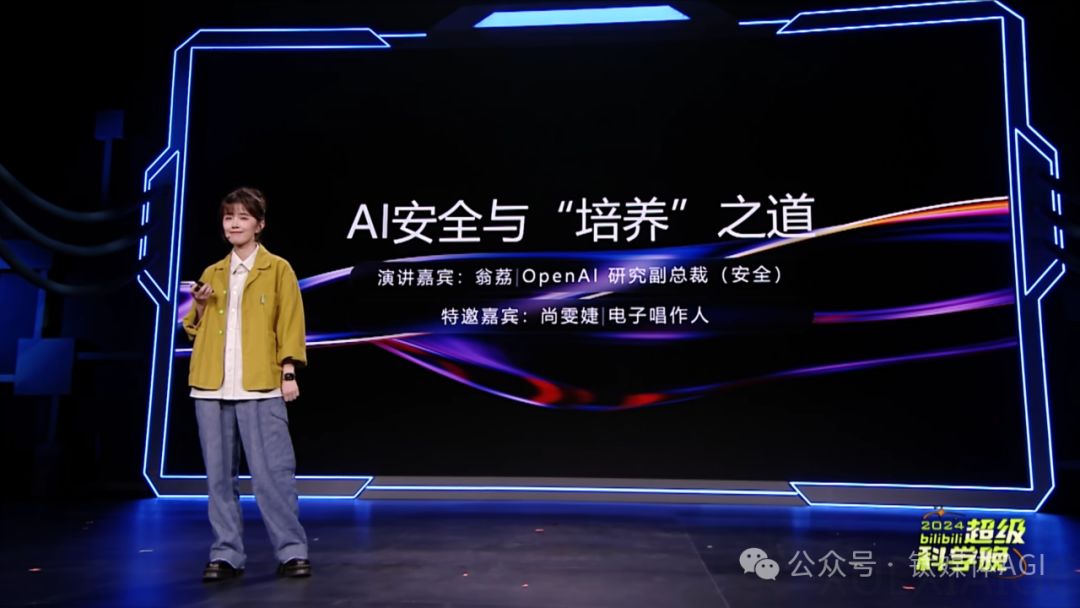

在2024年Bilibili超级科学晚上,OpenAI研究副总裁翁荔发表了关于AI安全与培养的演讲。她强调,随着AI技术的快速发展,确保其行为符合人类价值观和安全性变得至关重要。翁荔指出,AI可能因数据偏见而变得狭隘,或因对抗性攻击而受到质疑,因此需要用心引导AI,确保其服务于人类并确保安全。

翁荔提出,为了减少AI的偏见,需要提供多样、全面、正确的数据,并依赖多人标注的数据以提高AI的准确性。她还提到了基于强化学习(RL)和基于人类反馈的强化学习(RLHF)的技术,通过奖惩机制训练AI,类似于训练小狗。此外,使用模型自我评价和详细的行为规则来提升AI的输出质量也是提升AI安全性的重要手段。

翁荔还强调了教会AI安全基本原则和道德准则的重要性,使其成为人类的伙伴。通过思维链(CoT)推理和扩展性研究来提升AI的可靠性和监督。她认为,AI安全需要每个人的参与,社区可以共同影响AI的成长。翁荔呼吁,AI技术是一把双刃剑,它带来的便利和挑战并行,我们的参与至关重要。AI的安全不仅仅是研究者的责任,它需要每一个人的参与。

翁荔的演讲内容强调了AI安全的重要性,并提出了多种方法来提升AI的安全性和可靠性,包括数据的多样性和准确性、强化学习技术的应用、模型自我评价和行为规则的制定,以及社区的共同参与。她的观点为AI技术的安全发展提供了深刻的见解和实用的指导。

原文和模型

【原文链接】 阅读原文 [ 2915字 | 12分钟 ]

【原文作者】 钛媒体AGI

【摘要模型】 moonshot-v1-32k

【摘要评分】 ★★★☆☆

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...