文章摘要

【关 键 词】 AGI研究、AI安全、政策顾问、非营利组织、AI政策

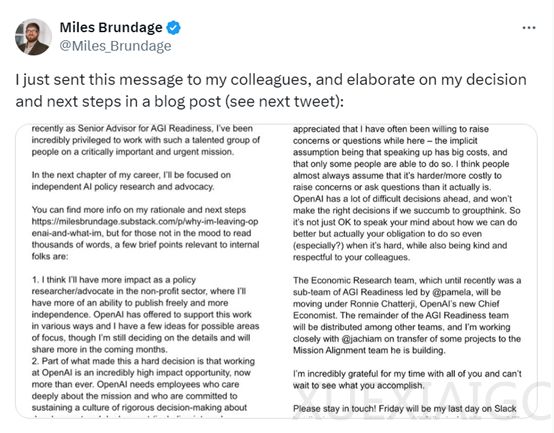

OpenAI的高级AGI研究顾问Miles Brundage宣布了他的离职。自2018年加入OpenAI以来,Brundage在公司内担任了多个关键职位,包括研究科学家、政策研究负责人和高级AGI顾问。他的工作重点是确保OpenAI产品的安全性和可靠性。在任期间,他领导了外部红队计划,测试AI系统的安全性,推动了“系统卡”报告的创建,为公众和研究者提供了透明度。Brundage还积极参与了AI政策研究,包括负责任的部署、AI安全监管、经济影响和有益应用的推进。

Brundage在牛津大学的未来人类研究所工作期间,专注于AI政策和治理问题,他的学术背景为他在AI政策领域的工作提供了坚实的基础。他发表的长文解释了他离开OpenAI的原因,主要是希望在非营利部门作为研究人员和倡导者产生影响,拥有更多的发表自由。他计划创立或加入非营利组织,专注于人工智能政策研究和宣传。

Brundage的研究兴趣涵盖了AI进展的评估和预测、AI安全的监管问题、AI的经济影响、有益AI应用的加速推进和计算治理。他认为,尽管离开了OpenAI,但在外部可以更有效地推动某些政策工作,并对公司的使命持乐观态度。

在讨论AGI的准备情况时,Brundage指出,无论是OpenAI还是世界本身,都还没有准备好迎接AGI。他强调,AI能力的迅速提高要求政策制定者更紧迫地采取行动。实现AGI惠及全人类需要多方面的决策者做出深思熟虑的选择,并需要公众讨论和谨慎执行。目前,OpenAI尚未公布谁将接替Brundage的工作。

原文和模型

【原文链接】 阅读原文 [ 865字 | 4分钟 ]

【原文作者】 AIGC开放社区

【摘要模型】 moonshot-v1-32k

【摘要评分】 ★☆☆☆☆