文章摘要

【关 键 词】 AI发展、Meta公司、算力投资、个性化AI、开源策略

Meta公司CEO扎克伯格在专访中讨论了公司在人工智能领域的发展,特别是其大型语言模型(LLM)Llama系列。他确认了Llama-4模型使用了超过10万个GPU进行训练,显示出Meta在AI领域的重大投资和对算力的重视。扎克伯格认为AI大模型的潜力巨大,目前还未达到极限,而Meta的算力资源将有助于进一步挖掘模型性能和商业潜力。

在AI领域,扎克伯格强调了两个主要方向:一是在增强现实和混合现实中提供在场感,二是发展个性化AI。他提到,尽管实现全面的在场感面临挑战,如触觉反馈和物理表现,但Meta致力于通过技术进步来解决这些问题。个性化AI的发展需要模型理解用户的生活背景,而眼镜作为理想的外形因素,可以获取用户的视觉和听觉信息。

扎克伯格还讨论了AI在社交媒体中的应用,预计AI将加速社交媒体的变化,从朋友互动转向与创作者或非熟人内容的互动。AI将提供更多创作工具,使朋友和创作者能制作更有趣的内容,同时也会有AI生成的个性化内容。

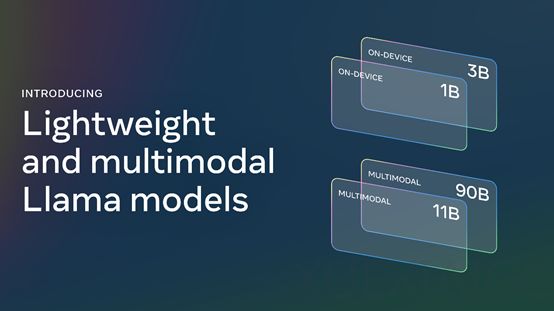

在开源方面,扎克伯格认为开源意味着更多的创新和安全,因为开源软件允许更多人审查,问题能更快被发现和解决。Meta开源了轻量级多模态大模型Llama-3.2,这是专为移动端设计的模型,具有强大的性能。Llama-3.2包含不同参数的版本,支持在移动设备上本地运行,并针对Arm处理器进行了优化。

此外,Meta还推出了Llama Stack Distribution,以简化开发者和企业围绕Llama构建应用的流程。Llama Stack提供了部署灵活性,支持从单机单节点分布到可扩展的云部署等解决方案,并为需要内部AI能力的公司提供了本地分发选项。

总的来说,Meta在AI领域的投资和开源策略显示了公司对未来技术发展的重视,以及其在推动AI技术进步和普及方面的雄心。

原文和模型

【原文链接】 阅读原文 [ 3490字 | 14分钟 ]

【原文作者】 AIGC开放社区

【摘要模型】 moonshot-v1-32k

【摘要评分】 ★★★★★