Llama 3.1发布,性能媲美最强闭源大模型

文章摘要

【关 键 词】 AI模型、Llama 3.1、开源竞争、多语言支持、AI安全性

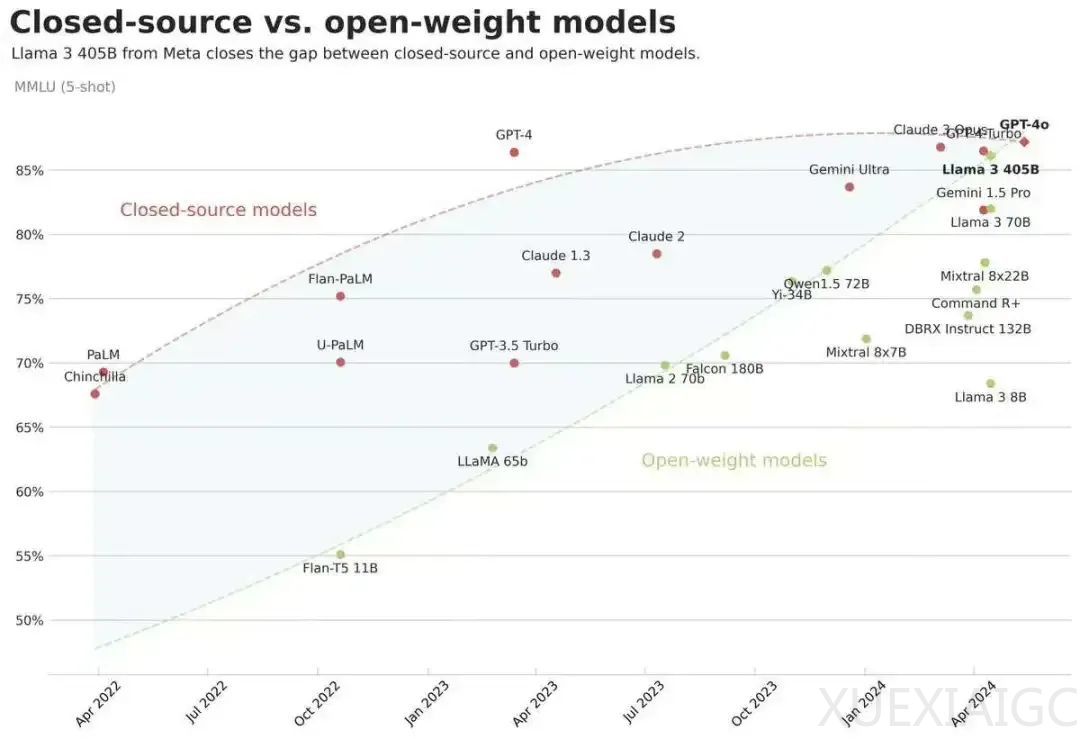

Meta公司于美国太平洋时间7月23日发布了其最新的人工智能(AI)模型Llama 3.1,标志着开源大型语言模型(LLM)与闭源LLM竞争的新时代。Llama 3.1被认为是目前功能最强、性能最优的生成式AI产品,其发布包括8B、70B和405B三个尺寸版本。

Llama 3.1 405B作为最受关注的版本,被Meta称为全球最大、功能最强的公共基础模型,能够与OpenAI和Google开发的顶级模型相媲美。Meta在官方博客中表示,Llama 3.1 405B是首个公开可用的模型,在通用常识、可引导性、数学、工具使用和多语言翻译等方面具有与顶级AI模型相媲美的能力,其发布将带来前所未有的创新和探索机会。

Meta在超过150个基准数据集上对Llama 3.1进行了性能评估,并与竞品进行了比较。结果显示,Llama 3.1 405B在各项任务中都具有与当前最先进的闭源模型竞争的能力。此外,8B和70B版本在与同级别的小参数模型对比中也表现出色。

Llama 3的推出和Meta向生成式AI的全面转型,使得该产品被广泛应用于Meta的大多数产品线,包括Instagram、Messenger和WhatsApp。Meta CEO扎克伯格表示,将AI作为开源工具向所有人开放非常重要,以确保世界上更多的人能享受到AI带来的红利和机会。

Meta开发开源AI模型的努力也促使其他AI开发者,包括去中心化AI公司Venice AI、Brave浏览器开发者Brave和Perplexity AI,将Llama 3添加到他们的平台上。Venice AI创始人Erik Voorhees表示,Meta值得高度赞扬,因为他们花费了数亿美元来训练一个最先进的模型,并免费向全世界开放。

在开发Llama 3.1 405B的过程中,Meta面临的最大挑战是模型规模的整体增长,支持更大的12800-token上下文窗口,并提供多语言支持。Meta AI现在可以用法语、德语、印地语、意大利语、葡萄牙语和西班牙语进行响应。

关于AI安全性方面,扎克伯格强调AI应避免所有类型的伤害。他指出,非故意伤害是指即使操作人员无意,AI系统也可能造成伤害;故意伤害是指不法分子使用AI模型故意造成伤害。在故意滥用的情况下,主要的AI开发者对与选举相关的提示施加了限制,以遏制使用其模型传播错误信息。扎克伯格表示,开源软件的透明性有助于缓解非故意伤害的担忧,并认为使用Llama及其安全系统如Llama Guard可能比闭源模型更安全。

Llama 3.1的发布还包括Llama Guard 3,一款旨在监控和执行模型道德使用的工具。扎克伯格相信,Llama 3.1的发布将成为AI行业的一个拐点,开源AI代表了世界上最好的一次利用这项技术创造最大经济机会和安全性的机会。

原文和模型

【原文链接】 阅读原文 [ 1085字 | 5分钟 ]

【原文作者】 AI大模型实验室

【摘要模型】 moonshot-v1-32k

【摘要评分】 ★★☆☆☆