文章摘要

【关 键 词】 神经网络、自动化设计、进化算法、人工智能、模型优化

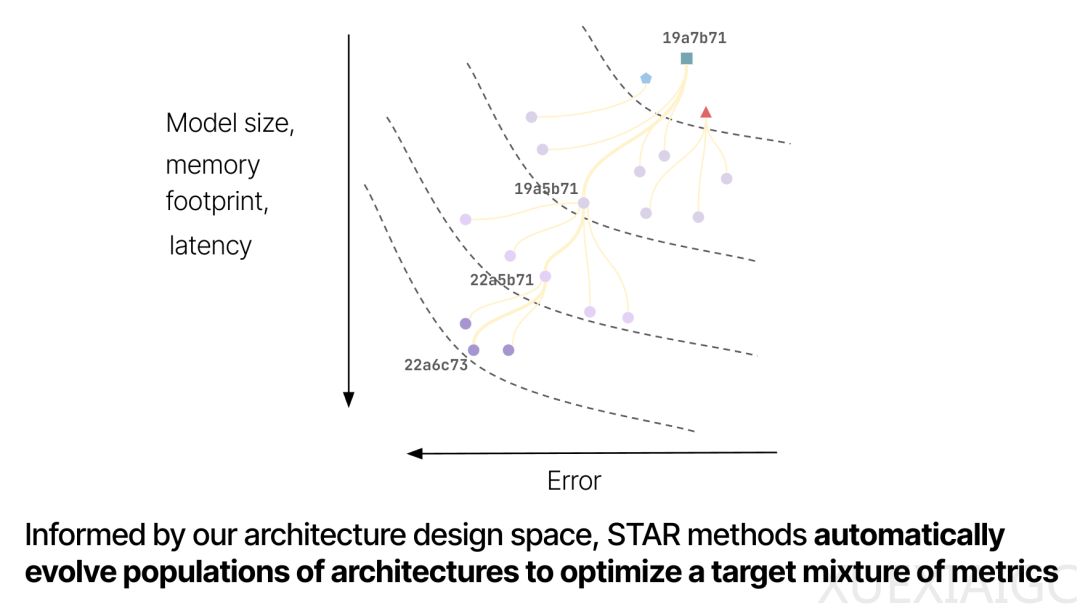

麻省理工学院孵化的初创公司Liquid AI近期宣布了其在自动化神经网络架构设计和定制方面的重大进展。该公司开发了一种名为基于进化算法的定制架构合成(STAR)算法,该算法基于新的设计理论,为模型架构提供数值表示。STAR算法自动化了架构发现和优化过程,使其成为端到端的过程,并允许根据特定任务、指标和硬件定制架构。Liquid AI利用STAR合成了数百种设计,这些设计在质量上优于Transformer和混合架构,同时具有更小的缓存和参数数量。

模型架构设计是人工智能领域的一个关键领域,它影响着从扩展能力、效率到预训练、对齐和推理等多个方面。设计中的挑战在于平衡质量和硬件约束,尤其是延迟和内存成本,以确保人工智能系统能在不同环境中有效部署。Liquid AI的STAR算法通过自动化方法解决了这一挑战,它依赖于进化优化原理,将模型架构表示为STAR基因组的分层数值序列,并对其进行迭代进化。

STAR的核心创新之一是将模型架构表示为STAR基因组,这是一个分层数值序列,Liquid AI使用进化优化原理对其进行进化。这个过程是迭代的:将基因组编译成具体的架构,对其进行评估,然后选择并重组性能最佳的架构来创建下一代。进化过程可以由静态和动态目标指导,静态目标由架构的特定配置给出,而动态目标需要评估架构,例如通过测量其在给定数据集上训练后的困惑度或其在目标硬件上的延迟。

Liquid AI的STAR基因组依赖于其设计理论,该理论为神经网络引入了一类新的通用计算单元:线性输入可变系统(LIV)。LIV是结构化运算符,其动作由输入本身逐点调制,并提供抽象来泛化不同类别的计算单元,如注意力变体、线性注意力、(门控)卷积、具有线性状态转换的(门控)递归、状态空间层和(门控)线性单元。

Liquid AI在改进的语言建模架构的设计中评估了STAR,针对三个组合目标进行优化:质量(训练后的困惑度)、质量和参数效率、以及质量和缓存效率。在短短的两到三轮进化之后,大多数架构的表现都优于Transformer和强混合基线等主流产品,并且随着更多轮次的执行,其表现持续改善。Liquid AI发现,当仅优化质量时,所有经过评估的STAR进化架构在下游评估基准上的表现都优于注意力循环混合架构,在基准上的改进是Transformer混合架构的两倍。

STAR不仅针对特定目标优化架构,还提供了一种分析工具,用于识别进化过程中出现的重复架构主题,从而推动观察到的性能提升。Liquid AI现在希望进一步完善STAR的进化算法和初始种群,使每一代都比上一代更好,包括在基因组层次结构的最低级别进行优化。

原文和模型

【原文链接】 阅读原文 [ 2316字 | 10分钟 ]

【原文作者】 AI前线

【摘要模型】 moonshot-v1-32k

【摘要评分】 ★★★★★