文章摘要

【关 键 词】 LLM研究、语言偏向、英语核心、概念表达、处理机制

在探索多语言大型语言模型(LLM)的内部工作机制时,研究人员好奇这些模型是否真的将英语作为其内部处理语言。来自洛桑联邦理工学院的研究人员对Llama 2家族的模型进行了深入研究。这些模型在以英语为主的语料库上进行了训练,尽管也包含了其他语言的语料。

研究显示,尽管LLM接受多语言训练,但在处理任务时,尤其在推理过程中,它们倾向于以一种偏向英语的方式思考。通过特殊的实验设计,研究人员观察到,在执行翻译任务时,模型在内部层的处理过程中,即便提示中不含任何英语,其推理路径仍显示出英语的特征。

更有趣的是,这种“母语”现象并非仅仅是词汇层面的。研究人员强调,模型使用的“内部语言”实际上是更抽象的概念表达,而这些概念表达在语义上更接近英语。换句话说,英语不仅仅是LLM的外部接口语言,还在模型的深层次处理中扮演了一种基础语言的角色。

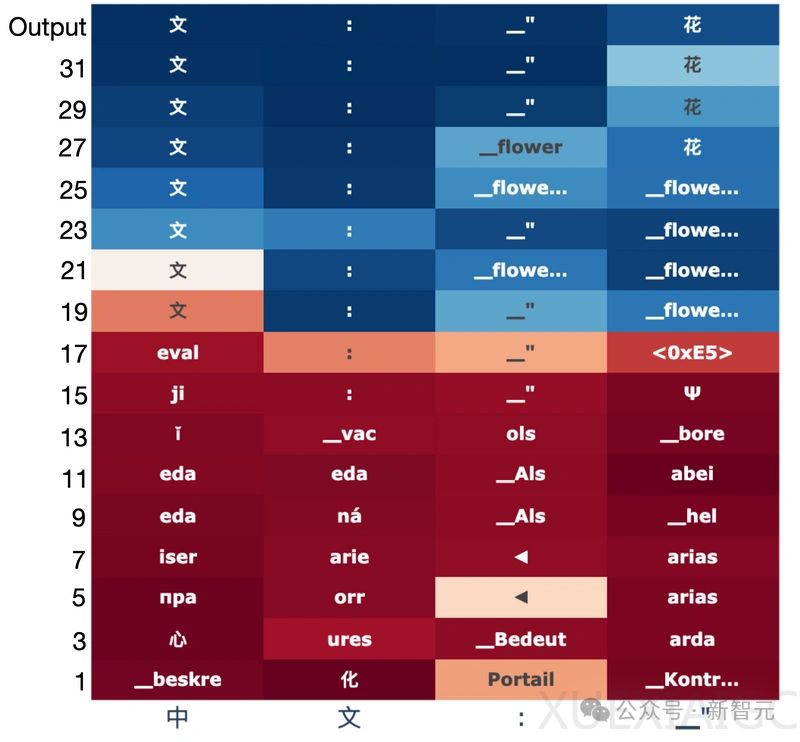

实验进一步揭示了模型在处理不同语言输入时的动态变化。在多步骤的处理过程中,模型首先将输入归一化,然后进入一个抽象的概念空间,最终再映射回特定的语言表达。在这个过程中,英语作为一种“通用语”的色彩贯穿始终。

此外,网友的观察也支持这一发现,他们指出LLM在生成输出时,英语的倾向性是显而易见的,尤其是在诗歌创作等领域。

最后,通过对LLM在处理过程中的高维空间路径进行可视化,研究人员进一步阐释了模型如何在不同阶段处理和转换信息。这揭示了模型在概念和语言层面上的复杂互动,并强调了英语在这些模型内部机制中的核心地位。

原文和模型

【原文链接】 阅读原文 [ 2752字 | 12分钟 ]

【原文作者】 新智元

【摘要模型】 glm-4

【摘要评分】 ★★★★★

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...