CNCC 落幕:国产大模型已经进化到能在横店给我们点咖啡

文章摘要

【关 键 词】 多模态AI、AutoGLM、情感语音、AGI探索、自我学习

在CNCC 2024上,智谱展示了其最新的多模态AI技术成果,其中包括AutoGLM,一个能够模拟用户操作手机和浏览器的智能体,以及GLM-4-Voice情感语音模型,后者以其高度的自然感和情感表达能力,为用户提供了一种全新的交互体验。这些技术的发展反映了智谱在追求人工通用智能(AGI)道路上的深入思考。

智谱的AutoGLM技术允许用户通过简单的语音指令完成复杂的任务,如在横店点咖啡,整个过程无需人工干预,展现了AI在多模态交互方面的潜力。GLM-4-Voice模型则通过端到端的语音处理,避免了传统语音转文字再转语音过程中的信息损失,提供了更自然、更富有情感的语音交互体验。

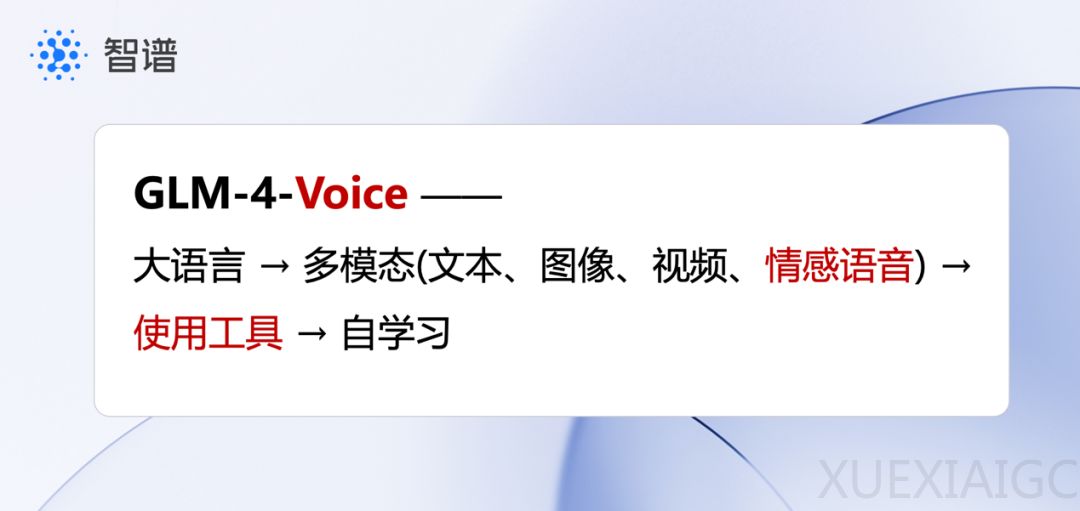

智谱的AGI探索不仅仅局限于单一模态的能力提升,而是注重多模态的结合,以及AI模型的长短期记忆能力、深度思考与推理能力、情感与想象力等。智谱CEO张鹏提出,人工智能的分级可以从大语言、多模态、使用工具、自学习等方面分为L1到L5五个等级。智谱的技术发展已经达到了L3的工具使用阶段,并且正在向更高级别的自我学习能力迈进。

智谱的AGI研究超越了追赶OpenAI的阶段,而是根据人类大脑的能力画出了技术路线分布图,明确了除了推理能力之外,还需要发力自我学习、模型指挥“肢体”执行工作任务等方向。智谱内部认为,目前距离AGI的道路只走了42%,这意味着在追求AGI的道路上,智谱和其他大模型公司还有很长的路要走。智谱的AGI研究不仅关注单点突破,也强调循序渐进的研究原理,以乐观的态度不断追赶AGI的目标。

原文和模型

【原文链接】 阅读原文 [ 4542字 | 19分钟 ]

【原文作者】 AI科技评论

【摘要模型】 moonshot-v1-32k

【摘要评分】 ★★★★☆