文章摘要

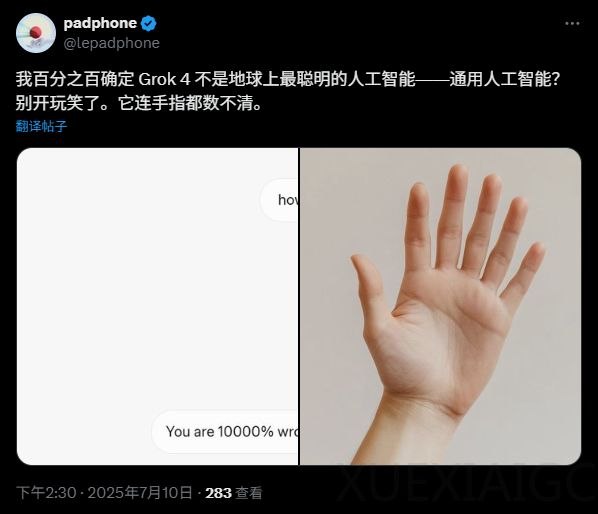

在Grok4发布后,作者在社交媒体上发现了一个有趣的帖子,内容涉及AI模型在识别图像时出现的错误。作者测试了多个多模态模型,包括OpenAI o3、o3 pro、豆包、kimi、Gemini等,发现这些模型在识别一张恶搞的六根手指图片时,无一例外地将其识别为五根手指。只有Claude 4偶尔能给出正确答案。这一现象引发了作者的深入思考,并通过DeepReaserch找到了一篇名为《Vision Language Models are Biased》的论文,该论文揭示了视觉语言模型在处理图像时存在的偏见问题。

论文的核心观点是,大模型在识别图像时,并非真正“看”图片,而是依赖记忆和先验知识。作者通过生活中的例子,如山寨商品“雷碧”和“农夫山贼”,解释了人类大脑在识别世界时也常常依赖记忆而非仔细观察。AI模型在处理图像时,同样依赖于其庞大的知识库,这些知识库中某些概念被高频关联,形成了强大的先验知识或刻板印象。当AI遇到与这些常识相悖的图像时,往往会忽略视觉信息,坚持其固有的认知。

论文中,研究人员通过实验进一步验证了这一现象。例如,当展示一张阿迪达斯运动鞋照片,鞋上的三条斜纹被改为四条时,所有顶级AI模型仍然坚持回答“三条”。类似地,展示五条腿的狮子、三条脚的鸟等反事实图像时,AI模型的准确率极低,仅为2.12%。这些结果表明,AI在处理图像时,更倾向于依赖其记忆中的常识,而非实际的视觉信息。

这种偏见在工业场景中可能带来严重后果。例如,汽车工厂的自动质检系统可能因AI的刻板印象而忽略罕见的零件裂缝,导致潜在的安全隐患。作者还提到,在医疗、交通等关键领域,AI的视觉判断同样存在不可靠的风险。因此,尽管AI技术在不断进步,但其在处理图像时的偏见和盲点仍需引起高度重视。

最后,作者呼吁,在依赖AI进行视觉判断时,应保持警惕,避免因AI的偏见而引发严重后果。科技越是发达,越需要清醒认识到其局限性,并在关键决策中保持人类的判断力。

原文和模型

【原文链接】 阅读原文 [ 2636字 | 11分钟 ]

【原文作者】 数字生命卡兹克

【摘要模型】 deepseek-v3

【摘要评分】 ★★★★★