7B超越百亿级,北大开源aiXcoder-7B最强代码大模型,企业部署最佳选择

文章摘要

【关 键 词】 代码大模型、企业级应用、aiXcoder团队、模型开源、编程效率

随着大语言模型在编程领域的集成,代码生成与补全任务的自动化已成为业界的重要趋势。OpenAI的CodeX、谷歌的AlphaCode、HuggingFace的StarCoder等模型已经在帮助程序员提高编码效率。北京大学软件工程研究所的aiXcoder团队,凭借10年的深度学习在软件开发领域的探索,开源了全自研的aiXcoder 7B代码大模型,该模型在代码生成和补全任务中表现出色,尤其在企业级项目开发中展现了其个性化训练、私有化部署和定制化开发的优势。

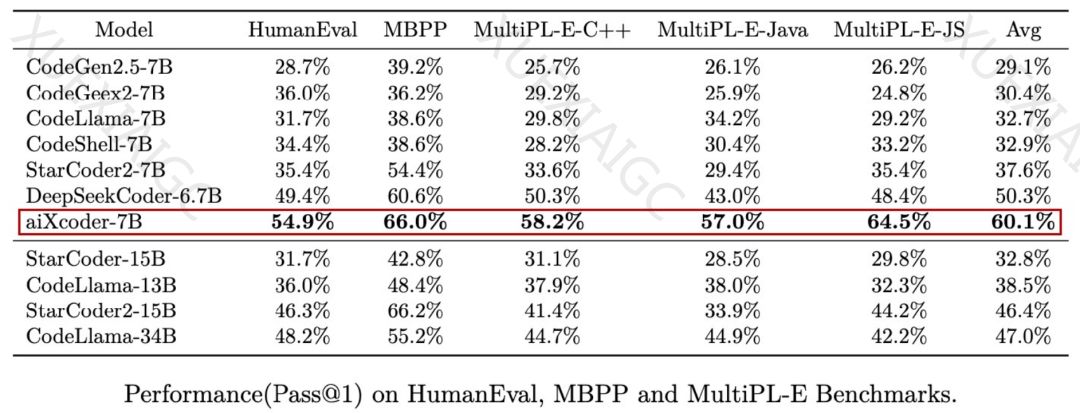

aiXcoder 7B模型在多个代码生成效果评估测试集上的准确率远超当前主流代码大模型,尤其在真实开发场景中的代码补全任务上表现突出。该模型提供了32k的预训练上下文长度,是同量级模型中最大的,且能够在推理时扩展至更长。aiXcoder 7B Base版在代码补全过程中能够自动判断何时停止生成代码,这得益于结构化Span技术的应用。此外,模型在aiXcoder扩展基准测试集上显示出倾向于使用较短的代码完成任务的能力。

在多文件补全场景中,aiXcoder 7B Base版同样表现优异,能够从上下文中提取最关键的信息,这是通过对上下文的进一步信息处理和构建多文件之间的相互注意力关系实现的。模型的训练还得益于1.2T的高质量训练数据,其中包括来自GitHub、Stack Overflow、Gitee等的数据,以及经过过滤处理的CSDN数据。

aiXcoder 7B Base版的实战效果同样令人瞩目,无论是代码生成还是补全,都能显著提升程序员的工作效率。在企业级应用方面,aiXcoder 7B Base版通过私有化部署、个性化训练和定制化开发,满足了企业的个性化需求,成为企业首选的代码大模型。

aiXcoder团队自2013年起就开始深耕代码分析研究,发表了100余篇相关论文,并多次获得国际学术奖项。团队先后推出了多个版本的aiXcoder模型,包括专注于企业适配的aiXcoder Europa,以及最新开源的aiXcoder 7B Base版。aiXcoder团队的工作不仅推动了代码大模型行业的进步,也为软件开发自动化和业务效率的提升提供了支持。目前,aiXcoder已服务于多个行业的头部客户,并获得了资本市场的认可和投资。随着AIGC的发展,aiXcoder团队已做好准备迎接挑战。开源链接提供了对aiXcoder 7B模型的访问途径。

原文和模型

【原文链接】 阅读原文 [ 3961字 | 16分钟 ]

【原文作者】 机器之心

【摘要模型】 gpt-4

【摘要评分】 ★★★★★