42.5 Exaflops:谷歌新TPU性能超越最强超算24倍,智能体协作协议A2A出炉

文章摘要

【关 键 词】 AI芯片、推理优化、算力提升、智能体协作、生成式AI

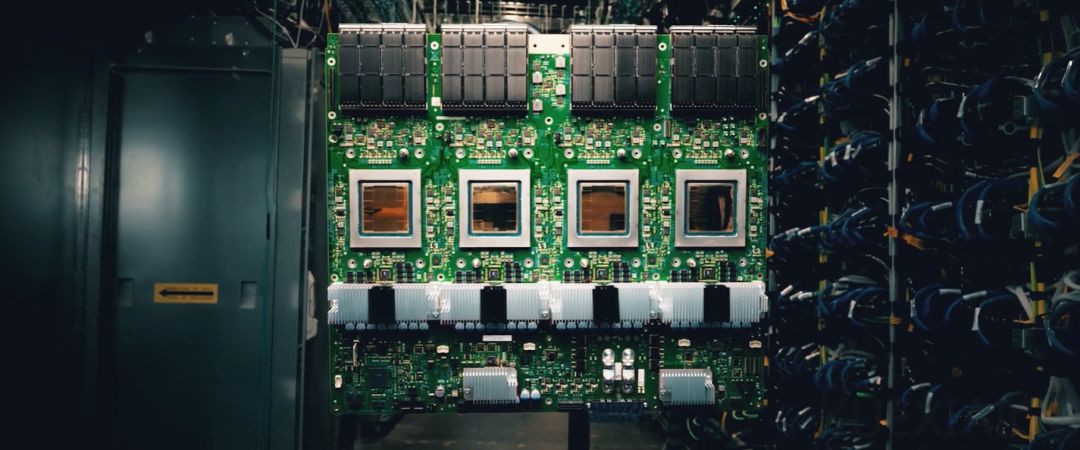

谷歌近日发布了第七代张量处理单元(TPU)Ironwood,标志着其AI芯片研发战略的重大转折。与前几代TPU不同,Ironwood是第一款专为推理而设计的芯片,旨在支持生成式AI的下一阶段及其巨大的计算和通信需求。Ironwood的算力在扩展至9216块芯片时可达42.5 exaflops,是全球最快超级计算机El Capitan的24倍以上。单芯片规格上,Ironwood显著提升了内存和带宽,每块芯片配备192GB高带宽内存,内存带宽达到7.2 terabits/s,是上一代TPU Trillium的4.5倍。此外,Ironwood的计算效率也大幅提升,每瓦性能是Trillium的两倍,比2018年推出的首款TPU高出近30倍。

谷歌副总裁Amin Vahdat表示,Ironwood的推出标志着“推理时代”的到来,AI代理将主动检索和生成数据,以协作方式提供洞察和答案。谷歌认为,AI的未来不仅在于更大的模型,还在于能够分解问题、进行多步骤推理并模拟类人思维过程的模型。Ironwood被定位为谷歌最先进AI模型的基础设施,优化的大模型包括自家的Gemini 2.5,其“原生内置了思维能力”。谷歌还发布了Gemini 2.5 Flash,作为最新旗舰模型的缩小版本,定位于对响应速度敏感的日常应用。

除了硬件,谷歌还展示了其全套多模态生成模型,包括文本转图像、文本转视频以及新发布的文本转音乐功能Lyria。谷歌还宣布推出Cloud WAN,使企业能够访问Google的全球规模私有网络基础设施,并扩展其面向AI工作负载的软件产品,包括由Google DeepMind开发的机器学习运行时Pathways。

谷歌还提出了以多智能体系统为中心的AI愿景,发布了促进智能体发展的协议Agent-to-Agent(A2A),旨在促进不同AI智能体之间的安全、标准化通信。A2A协议允许跨平台、跨框架的智能体实现互操作,为它们提供了共同的“语言”和安全的通信渠道。谷歌强调,A2A与MCP(模型上下文协议)是互补的:MCP为智能体提供工具支持,而A2A则让这些装备了工具的智能体能够相互对话和协作。

谷歌还宣布将在其Gemini模型和SDK中添加对MCP的支持,MCP已成为连接语言模型与工具和数据的一种简单、标准化方式。MCP使AI模型能够从企业工具和软件等数据源获取数据以完成任务,并访问内容库和应用程序开发环境。谷歌DeepMind首席执行官Demis Hassabis表示,MCP是一个优秀的协议,正在迅速成为AI智能体时代的开放标准。

总的来说,谷歌通过Ironwood的发布和A2A协议的推出,展示了其在AI硬件和软件领域的全面布局,旨在推动生成式AI和多智能体系统的发展,为未来的AI应用奠定坚实基础。

原文和模型

【原文链接】 阅读原文 [ 2466字 | 10分钟 ]

【原文作者】 机器之心

【摘要模型】 deepseek-v3

【摘要评分】 ★★★★★