文章摘要

【关 键 词】 人工智能、世界模型、推理能力、大语言模型、莫拉维克悖论

Meta首席AI科学家杨立昆在AI Action Summit 2025的演讲中指出,当前基于大语言模型的人工智能系统存在根本性缺陷。现有模型通过自回归生成token的暴力计算范式,本质上缺乏对物理世界的深度理解和常识推理能力,这导致其无法完成人类和动物轻松掌握的技能,例如灵活操控物体或处理复杂物理环境任务。尽管这些模型在语言生成和特定专业领域表现出色,但其底层机制仍受限于”系统一”直觉思维模式,难以实现真正的目标驱动型推理。

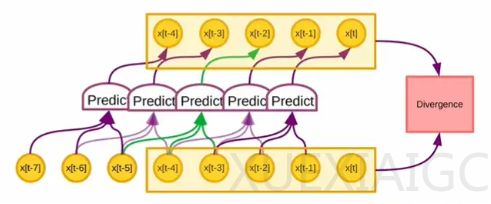

当前AI系统的核心问题源于其训练机制。大语言模型通过预测下一个token的生成模式,本质上是在重复统计模式而非构建世界模型。这种机制导致错误token的生成具有指数级发散风险,形成无法自我修正的”幻觉”现象。与之形成鲜明对比的是,人类婴儿仅需约16,000小时的视觉感知输入即可掌握基础物理规律,其接收的数据量(约10^14字节)与最大规模语言模型的训练数据量相当,但学习效率和理解深度存在本质差异。

实现高级机器智能需要突破现有范式。杨立昆提出构建基于能量函数的推理架构,通过优化不兼容性度量而非概率预测来实现系统二型思维。这种架构需要包含世界模型模块,能够预测动作序列对抽象状态的影响,并通过层次化规划实现多级任务分解。关键要素包括:从感官输入学习物理规律的能力、持久记忆系统、可解释的推理过程,以及通过硬编码安全约束确保可控性。

视觉感知数据的处理方式成为技术突破的关键障碍。生成式架构在视频预测中存在根本性缺陷,无法有效捕捉物理规律的内在结构。对此提出的解决方案是联合嵌入预测架构(JEPA),将预测目标从像素级重建转向抽象表示空间的兼容性评估。这种方法摒弃传统概率建模,通过能量函数直接衡量输入与输出的逻辑一致性,为建立真实世界模型提供新路径。

技术挑战集中在多层次表示学习领域。现有系统无法自主实现人类特有的层次化规划能力,即在不同抽象级别上同步处理肌肉控制、子任务分解和宏观目标设定。虽然动物和人类能自然完成从站立、开门到规划行程的多级任务,但当前AI系统仍需依赖人工设计的层次结构。杨立昆强调,突破这一瓶颈需要重新设计学习架构,使系统能自动发现并建立不同抽象层级的表示空间。

数据类型的局限性制约着智能发展。仅依赖文本数据无法培养出对物理世界的直观理解,这解释了为何当前AI在标准化测试中表现优异,却难以应对现实场景的细微变化。四岁儿童通过多模态感知建立的常识体系,暴露出纯文本训练系统的根本缺陷。要实现人类水平的智能,必须构建能整合视觉、听觉和运动感知的综合学习系统。

安全性与可控性设计被置于核心地位。通过能量函数内置的”护栏目标”机制,可在系统设计层面强制实现安全约束,这与当前依赖微调的安全策略形成对比。这种硬编码的安全保障机制,配合世界模型的可预测性,有望解决生成式模型固有的不可控风险。最终目标是创建既能进行复杂推理,又具备内在安全属性的智能系统,为未来无处不在的AI助手奠定技术基础。

原文和模型

【原文链接】 阅读原文 [ 9698字 | 39分钟 ]

【原文作者】 AI前线

【摘要模型】 deepseek-r1

【摘要评分】 ★★★★★