文章摘要

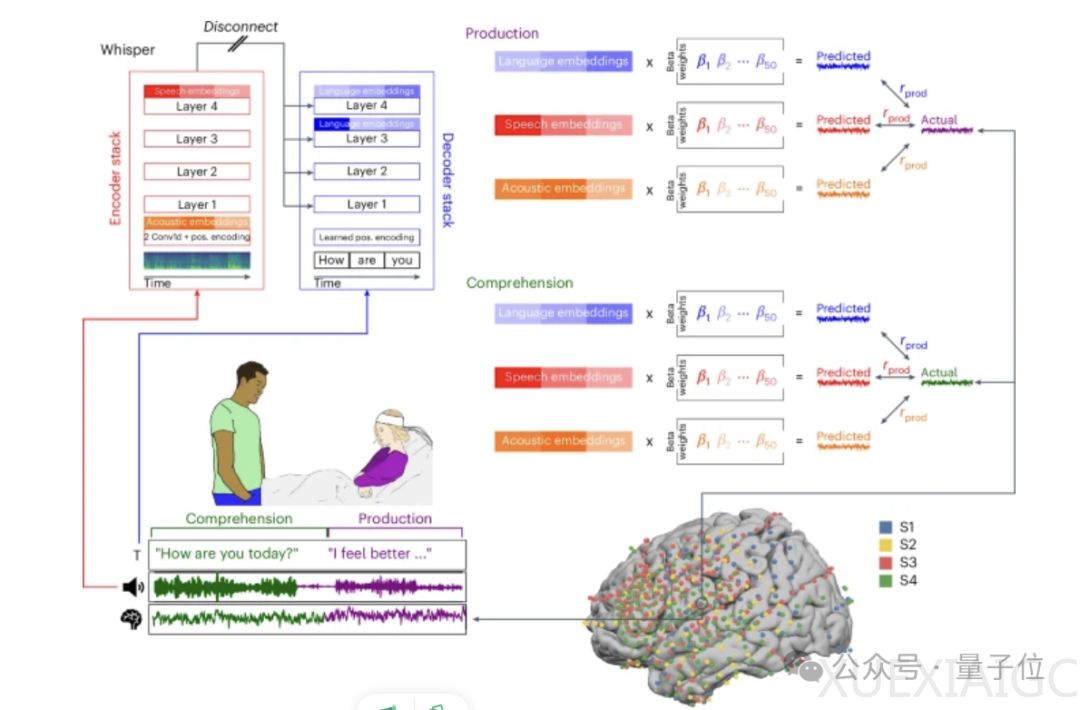

谷歌最新研究发现,大语言模型(LLM)的内部嵌入与人类大脑在语言处理过程中的神经活动呈现线性相关关系。这一发现通过将真实对话中的人脑活动与语音到文本模型的内部嵌入进行比较得出。研究团队使用皮层电图记录了参与者在开放式真实对话中的神经信号,累计100小时,同时从Whisper模型中提取了低级声学、中级语音和上下文单词嵌入。通过开发编码模型,将这些嵌入词线性映射到语音生成和理解过程中的大脑活动上,模型能够准确预测未用于训练的新对话中语言处理层次结构各层次的神经活动。

研究发现,语音到文本模型的嵌入为理解自然对话过程中语言处理的神经基础提供了一个连贯的框架。具体而言,当听到或说出每个单词时,语音嵌入和语言嵌入分别预测了大脑不同区域的神经活动。例如,听到“How are you doing?”时,语音嵌入首先预测颞上回(STG)的语音区域活动,随后语言嵌入预测布罗卡区(IFG)的活动。而在说话者准备发音时,语言嵌入先预测布罗卡区活动,随后语音嵌入预测运动皮层(MC)活动,最后语音嵌入再次预测STG的听觉区域活动。这种动态变化反映了神经处理的顺序:首先在语言区计划说什么,然后在运动区如何发音,最后在感知语音区监测说了什么。

研究还发现,Whisper模型的内部表征与自然对话过程中的神经活动一致,尽管大模型在并行层中处理单词,而人类大脑以串行方式处理,但两者反映了类似的统计规律。这种吻合揭示了神经处理中的“软层次”概念,即大脑中较低级别的声学处理和较高级别的语义处理部分重叠。

此外,研究团队通过过去五年的系列研究,探索了深度学习模型的内部表征与自然自由对话过程中人脑神经活动之间的相似性。例如,2022年发表在Nature Neuroscience上的论文显示,听者大脑的语言区域也会尝试在下一个单词说出之前进行预测,预测的信心会影响单词发音后的惊讶程度。另一篇发表在Nature Communications上的论文发现,大模型的嵌入空间几何图形捕捉到的自然语言中单词之间的关系,与大脑在语言区诱导的表征一致。

尽管大模型与人脑在计算原理上相似,但底层神经回路架构却明显不同。Transformer架构可同时处理成百上千个单词,而人脑语言区似乎是按顺序、逐字、循环和时间来分析语言的。基于这些研究成果,研究团队的目标是创建创新的、受生物启发的人工神经网络,提高其在现实世界中处理信息和发挥作用的能力。

原文和模型

【原文链接】 阅读原文 [ 1832字 | 8分钟 ]

【原文作者】 量子位

【摘要模型】 deepseek-v3

【摘要评分】 ★★★★☆