文章摘要

【关 键 词】 高清模型、多分辨率、NestedUNet、AI生成、图像质量

苹果公司的研究团队开发了一种新型的高清扩散模型,名为Matryoshka Diffusion Models(MDM),旨在解决传统扩散模型在生成高分辨率图像时面临的算力和时间消耗问题。MDM通过一种特殊的多分辨率扩散过程,允许模型在不同分辨率下同时进行去噪,并通过NestedUNet架构实现小尺度输入特征与大尺度结构的嵌套,从而提高训练效率和生成质量。

MDM的核心创新在于其多分辨率扩散过程,它不仅关注最终的高分辨率输出,还同时考虑中间的低分辨率信息。这种处理方式类似于在制作刺绣作品时,既关注整体图案设计,也注重每一针每一线的细节。MDM在扩展空间中定义了时间相关的潜在变量,这些变量包含多个不同分辨率的潜在变量,并且相互关联。

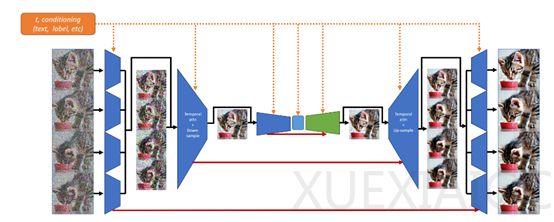

NestedUNet架构是MDM的另一个关键特点,它与传统的UNet架构相似,但专门设计用于处理多分辨率输入。NestedUNet通过将所有分辨率的潜在变量分组在一个去噪函数中形成嵌套结构,使得低分辨率潜在变量的计算能够为高分辨率潜在变量的计算提供信息。

在图像生成任务中,MDM能够有效地整合不同分辨率的图像信息。例如,在生成“海滩日落”的高分辨率图像时,MDM会从低分辨率的草图开始,逐步增加细节,如太阳的光辉、海浪的波纹和沙滩上的纹理。这一过程中,NestedUNet架构中的特征共享机制确保了生成图像在细节上的连贯性和一致性。

MDM还采用了渐进式多阶段训练方法,先从低分辨率开始训练,然后逐步增加分辨率,直至达到高分辨率输出。这种方法减轻了训练初期的计算压力,并有助于模型更好地学习不同分辨率之间的关联和转换规则。

总的来说,MDM通过其多分辨率扩散过程和NestedUNet架构,以及渐进式训练方法,提高了生成高分辨率图像的效率和质量,为AI生成内容(AIGC)领域带来了新的突破。

原文和模型

【原文链接】 阅读原文 [ 1146字 | 5分钟 ]

【原文作者】 AIGC开放社区

【摘要模型】 moonshot-v1-32k

【摘要评分】 ★★☆☆☆