文章摘要

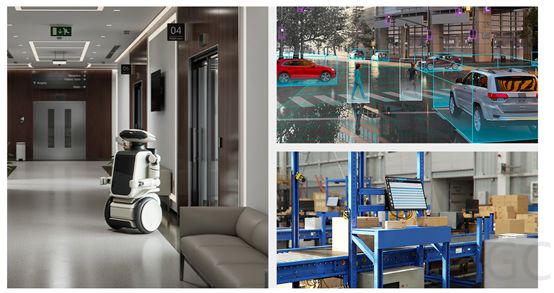

英伟达近日开源了其超大训练数据合集——NVIDIA Physical AI Dataset,这一数据集规模达到15T,涵盖了超过320,000个机器人训练轨迹和1,000个通用场景描述,并包含一个SimReady集合。该数据集旨在支持实体机器人和自动驾驶领域的AI模型开发,提供了真实世界和合成数据的混合,用于训练、测试和验证物理AI。此外,英伟达还计划推出专用于端到端自动驾驶汽车开发的多样化交通场景数据,这些数据将包括来自美国1,000多个城市和欧洲二十多个国家的20秒交通场景剪辑,为自动驾驶模型的训练提供了宝贵的资源。

Physical AI Dataset的核心价值在于其多样性和规模,能够帮助开发者在预训练和后训练阶段显著提升AI模型的性能。在预训练阶段,更多的数据有助于构建更健壮的模型;而在后训练阶段,AI模型可以通过在额外数据上训练来针对特定用例进行优化。然而,收集、策划和注释一个涵盖多样化场景并准确表示现实世界物理和变化的数据集是耗时且昂贵的,这成为了大多数开发者的瓶颈。特别是对于学术研究人员和小型企业来说,运行车队数月以收集自动驾驶汽车AI的数据是不切实际且成本高昂的,而且通常只有10%的数据被用于训练。尽管如此,这种规模的数据收集对于构建安全、准确、商业级模型是必不可少的。

该数据集还包含了数千小时的多摄像头视频,其多样性和地理覆盖范围是前所未有的,特别有利于安全研究领域。通过支持新的工作来识别异常值和评估模型泛化性能,这一努力也对NVIDIA Halos的全栈自动驾驶安全系统做出了贡献。此外,开发者还可以通过像NVIDIA NeMo Curator这样的工具进一步提升AI开发,这些工具可以高效地处理大量数据集以进行模型训练和定制。使用NeMo Curator,在NVIDIA Blackwell GPU上仅需两周时间就能处理2,000万小时的视频,相比之下,未优化的CPU管道则需要3.4年。

目前,已经有很多著名机构使用该数据集来训练AI产品。在圣地亚哥加州大学的机器人实验室中,包括专注于医疗应用、人形机器人和家庭辅助技术的团队,通过该数据集的机器人数据可以帮助开发能够理解空间上下文的语义AI模型,例如家庭、酒店房间和医院。在自动驾驶汽车领域,圣地亚哥实验室将该数据集应用于训练AI模型,以理解各种道路使用者的意图,并预测最佳行动方案。还可以使用该数据集来支持开发数字孪生模型,模拟边缘案例和恶劣天气条件。这些模拟可以用于在现实世界环境中罕见的情况下训练和测试自动驾驶模型。

在伯克利深度驾驶中心,这是一个领先的自动驾驶系统AI研究中心,该数据集可以支持开发自动驾驶汽车的策略模型和世界基础模型。卡内基梅隆大学安全AI实验室的研究人员计划使用该数据集,来推进他们评估和认证自动驾驶汽车安全性的研究工作。该团队计划测试在该数据集上训练的物理AI基础模型在模拟环境中罕见条件下的表现,并将其性能与在现有数据集上训练的自动驾驶汽车模型进行比较。

英伟达表示,未来将继续扩展Physical AI Dataset,将其建设成世界最大、统一的开源数据集,可用于AI模型、医疗、自动化驾驶等不同领域,加速AI、实体机器人的训练效率。这一举措不仅为开发者提供了宝贵的数据资源,也为AI技术的进一步发展奠定了坚实的基础。

原文和模型

【原文链接】 阅读原文 [ 1158字 | 5分钟 ]

【原文作者】 AIGC开放社区

【摘要模型】 deepseek-v3

【摘要评分】 ★★☆☆☆