文章摘要

【关 键 词】 Blackwell平台、AI芯片、数据中心、液体冷却、AI设计

Nvidia在Hot Chips 2024展会上展示了其Blackwell平台的最新进展,该平台是公司人工智能和数据中心战略的核心。Blackwell Ultra计划于明年推出,而Vera CPU和Rubin GPU预计将在2026年亮相,随后是2027年的Vera Ultra。Nvidia将Blackwell和Rubin视为不仅仅是GPU,而是整个平台和生态系统。

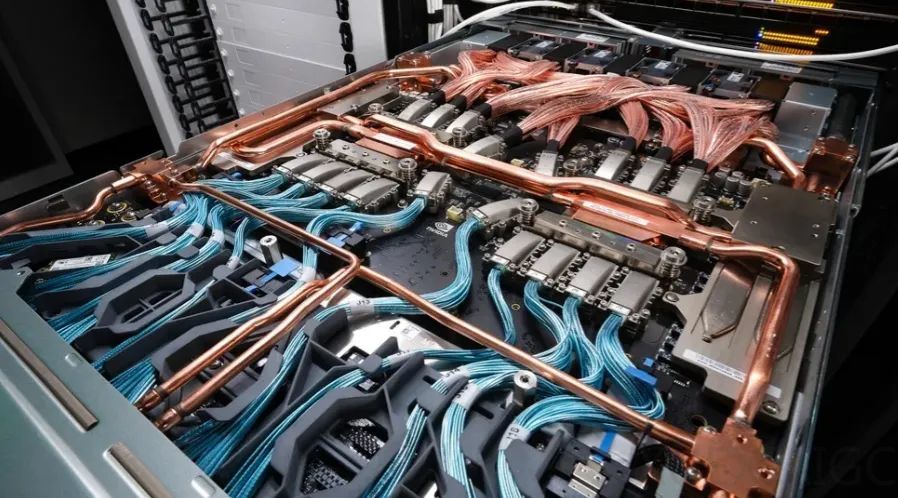

尽管有关于Blackwell发布推迟三个月的报道,Nvidia并未对此进行确认或否认,而是通过展示正在安装的Blackwell系统图像和更多内部硬件的照片和渲染图来回应。这些图像揭示了Blackwell硬件的耗电量和强大的冷却功能,暗示了其高昂的成本。

Nvidia还展示了现有Hopper H200解决方案的性能结果,特别是在使用NVSwitch时,推理工作负载的性能比点对点设计提高了1.5倍。Blackwell将NVLink带宽翻倍,通过NVLink Switch Tray提供总计14.4 TB/s的总带宽,以实现进一步的性能提升。

面对数据中心功率需求的增长,Nvidia正在与合作伙伴合作,通过使用温水冷却技术提高性能和效率。这种技术可以将加热的水再循环用于加热,从而降低成本。Nvidia声称,这种技术可以将数据中心的用电量减少28%,主要得益于移除低于环境温度的冷却硬件。

为了准备Blackwell,Nvidia增加了原生FP4支持,以进一步提高性能,并确保其最新软件能够从新硬件功能中受益,同时不牺牲准确性。通过使用Quasar量化系统调整工作负载,Nvidia能够在使用四分之一带宽的情况下提供与FP16相当的质量。

Nvidia还讨论了使用AI工具来设计更好的芯片,即“用AI构建AI”的概念。公司创建了一个内部使用的LLM,与Verilog语言一起工作,加速了设计、调试、分析和优化过程。这一工具是创建拥有2080亿个晶体管的Blackwell B200 GPU的关键,并将用于开发下一代Rubin GPU及以后的产品。

总体而言,Nvidia的未来几年AI路线图更加清晰,将“Rubin平台”与交换机和互连定义为一个整体包。在即将到来的Hot Chips会议上,Nvidia将分享更多关于Blackwell架构、使用生成AI进行计算机辅助工程和液体冷却的细节。

原文和模型

【原文链接】 阅读原文 [ 1053字 | 5分钟 ]

【原文作者】 半导体行业观察

【摘要模型】 moonshot-v1-32k

【摘要评分】 ★★☆☆☆