离职谷歌的Transformer作者创业,连发3个模型(附技术报告)

文章摘要

【关 键 词】 进化算法、基础模型、生成式AI、深度学习、日语模型

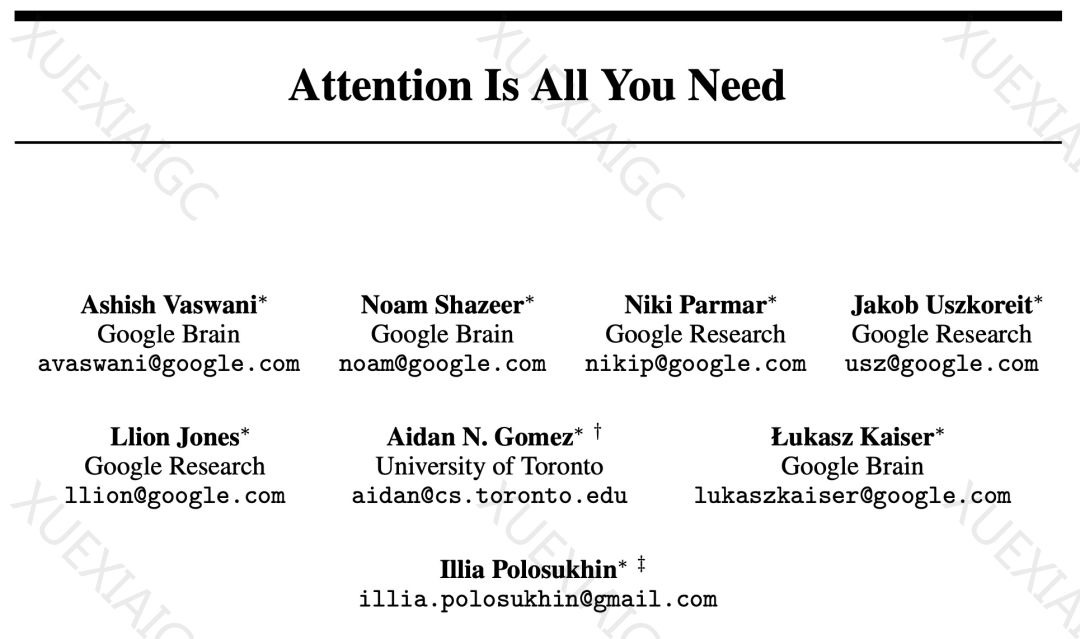

去年8月,前谷歌研究人员David Ha和Llion Jones创立了位于日本东京的人工智能公司Sakana AI,其中Llion Jones是谷歌2017年经典研究论文《Attention is all you need》的第五作者,该论文提出了深度学习架构transformer。Sakana AI致力于构建生成式AI模型,最近推出了一种通用方法Evolutionary Model Merge,使用进化算法发现组合不同开源模型的最佳方法,能够自动创建具有用户指定功能的新基础模型。通过该方法演化出的日语大语言模型(LLM)和日语视觉语言模型(VLM)在多个基准上取得了SOTA结果,其中日语LLM在数学推理方面表现出色,超过了一些70B参数LLM。团队还演化出了三个强大的基础模型:大语言模型(EvoLLM-JP)、视觉语言模型(EvoVLM-JP)和图像生成模型(EvoSDXL-JP),Evolutionary Model Merge方法能够自动生成新的基础模型,无需基于梯度的训练,节省计算资源。

Evolutionary Model Merge是一种通用进化方法,能够从选定的基础模型中自动生成合并模型,确保性能超过任何单个模型,核心是进化算法。该方法结合了合并数据流空间和合并参数空间中的模型,通过进化发现不同模型各层的最佳组合以形成新模型,以及混合多个模型权重的新方法。研究者通过实验证明,该方法能够创建具有新功能的新模型,如日语数学LLM和支持日语的VLM。其中,EvoLLM-JP是一个日语数学LLM,通过进化算法合并日语LLM和特定于数学的LLM,取得了出色的表现。EvoVLM-JP是一个日语视觉语言模型,通过合并流行的VLM和日语LLM,证明了进化算法在合并模型中的重要作用。EvoSDXL-JP则是根据提示生成图片的模型。

总体来看,Sakana AI团队通过Evolutionary Model Merge方法成功演化出多个具有SOTA性能的基础模型,展示了进化算法在发现新模型组合方面的潜力,为人工智能领域带来了新的可能性。详细的技术报告介绍了该方法的原理和实验结果,展示了其在合并不同模型方面的有效性和创新性。

原文和模型

【原文链接】 阅读原文 [ 1864字 | 8分钟 ]

【原文作者】 机器之心

【摘要模型】 gpt-3.5-turbo-0125

【摘要评分】 ★★★☆☆