开源模型越来越落后?Llama 3 说李总你真幽默

文章摘要

【关 键 词】 Llama 3、开源模型、语言模型、性能优化、多模态交互

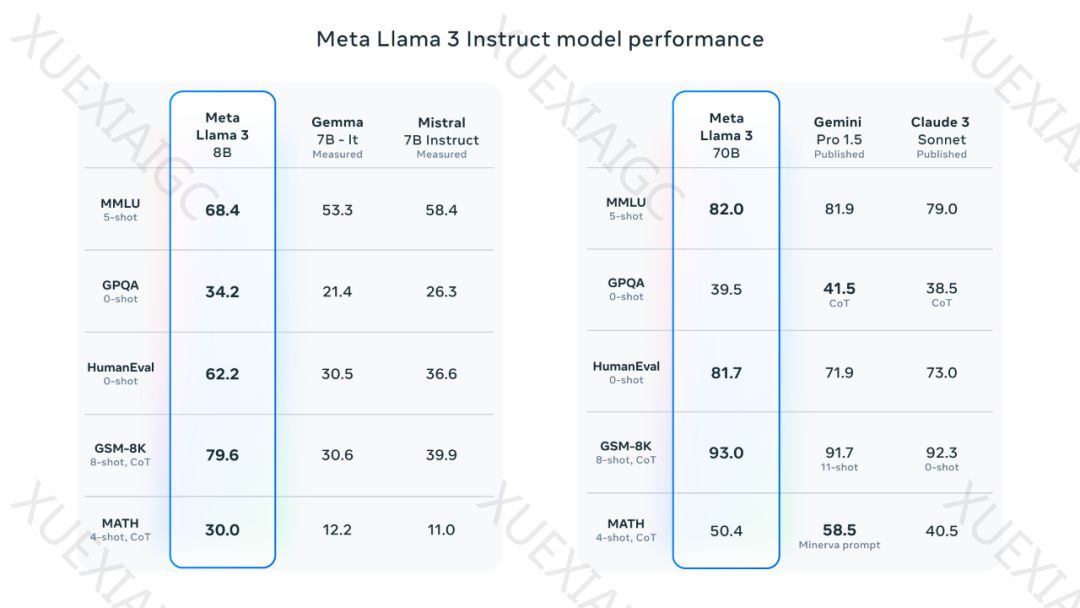

Llama 3 正式发布,被 Meta 宣称为迄今为止最强大的开源大模型。这一版本推出了两种规模的预训练语言模型,分别拥有 80 亿和 700 亿参数,以支持更广泛的应用场景。在多个行业基准测试中,Llama 3 展现了卓越的性能,并引入了包括推理能力提升在内的新功能。

Meta 的目标是通过 Llama 3 打造一系列能与市场上最优秀的专有模型竞争的开源模型,并根据开发者反馈提升帮助性。Meta 坚持开源原则,即“尽早发布,频繁更新”,以便社区能够在模型开发阶段即可使用。未来,Meta 计划让 Llama 3 支持多语言和多模态交互,提供更长的对话上下文,并在推理和编程等核心能力上持续优化性能。

新型的 80 亿和 700 亿参数 Llama 3 模型在性能上比前代有显著提升,尤其在推理、代码生成和指令执行等方面。Meta 通过人工评估集和与其他模型的比较,证明了 Llama 3 在真实场景中的优越性能。在模型架构方面,Llama 3 采用了仅解码器的 Transformer 架构,并在关键方面进行了改进,如使用了一个拥有 128K Token 的分词器,提升了语言编码的效率。

为了培养出顶尖的语言模型,Meta 构建了一个大型且高质量的训练数据集,覆盖了超过 15 万亿 Token,并且包含了超过 30 种语言的数据。Meta 还开发了一系列数据过滤流程,以确保训练数据的高质量,并进行了多种实验来评估不同来源数据的最佳混合方式。

在扩展预训练方面,Meta 制定了详尽的扩展规则来评估模型在各种下游任务中的表现,并采用了数据并行、模型并行和流水线并行三种并行技术来训练规模最大的 Llama 3 模型。此外,Meta 创新了指令调优的方法,结合了监督式微调、拒绝采样、近邻策略优化和直接策略优化等技术,显著提升了模型质量。

Meta 提供了包括 Llama Guard 2 和 Cybersec Eval 2 在内的信任与安全工具,并推出了 Code Shield,一个在推理时期过滤不安全代码的保护机制。此外,Meta 还与 torchune 合作开发了 Llama 3,这是一个 PyTorch 原生库,简化了编写、微调及试验 LLM 的过程。

在确保模型安全方面,Llama 3 通过了内部和外部的红队测试,并采纳了系统级的开发及部署策略。Meta 视 Llama 模型为更广泛系统的一部分,使开发者能够根据自己独特的目标进行设计,并更新了负责任使用指南(RUG),为 LLM 的负责任开发提供全面指导。

最后,Llama 3 将很快在所有主要平台上推出,其分词器效率和推理效率都有显著提升。Meta 的未来计划包括推出具备多模态、多语言对话能力、更长上下文窗口和更强大功能的新模型。Meta 致力于推动一个开放的 AI 生态系统的成长和发展,并负责任地发布模型,相信开放可以带来更优秀、更安全的产品,并加速创新。

原文和模型

【原文链接】 阅读原文 [ 3180字 | 13分钟 ]

【原文作者】 AI大模型实验室

【摘要模型】 gpt-4

【摘要评分】 ★★★★★