文章摘要

【关 键 词】 AI应用、大模型、Tokens消耗、技术进步、市场增长

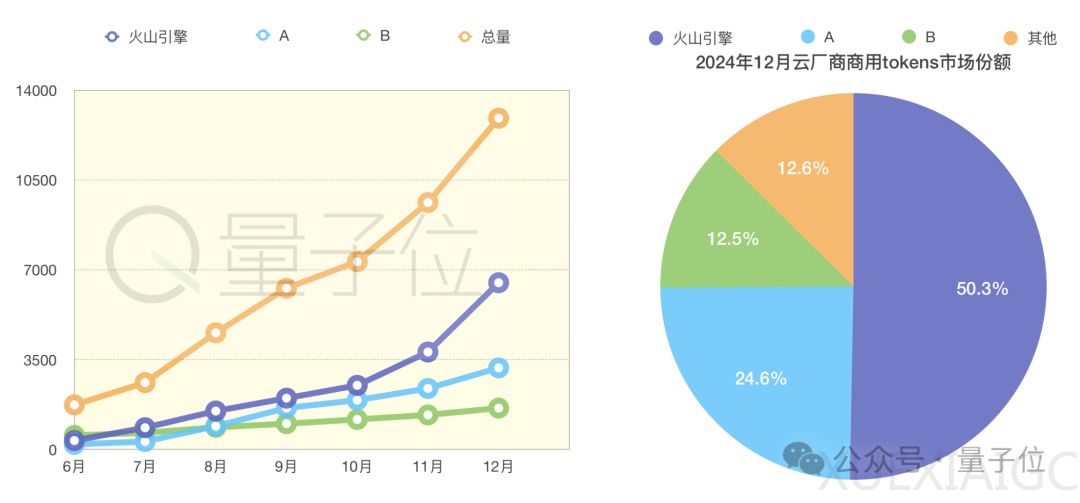

2024年下半年,国内大模型商用落地的日均Tokens消耗量激增,从1000亿级增长至10000亿规模,月复合增长率达到45%。火山引擎在这一领域表现突出,其商用Tokens日均消耗量的月均复合增长率超过60%,12月市场份额占比超过50%。这一增长背后,AI原生应用的爆发是核心因素,尤其是豆包大模型的日均Tokens使用量增长了33倍,达到4万亿。AI原生应用的下载量和活跃度显著提升,国产AI应用在全球总榜中占据重要位置。

Tokens在大模型中扮演着关键角色,作为模型理解和生成的最小意义单位,它不仅是原始文本数据与LLM之间的桥梁,还有助于模型处理各种任务。随着多模态领域的发展趋势,Tokens的应用也在扩展到视觉、音频等模态信息的标准化处理。

在行业落地层面,Tokens消耗量被用作衡量预训练语料规模、上下文长度、推理长度以及商业价值的单位。云厂商通过Tokens消耗量来证明自家云服务能力,而Tokens也成为大模型API的定价单位。火山引擎智能算法负责人吴迪指出,大模型API定价是一个科学计算的结果,综合了AI Infra承载力、市场未来用量、模型成本下降三个变量。

技术进步,如RAG、智能体、多模态的兴起,拓宽了大模型的应用场景,加速了整体趋势的进展。大模型红利的显现,使得企业对大模型的需求强烈,预计未来一年大模型可帮助企业降低成本、增加收入、缩短流程时间,并提高员工工作效率和产品创新水平。

火山引擎的豆包大模型在多个领域实现了合作和应用,覆盖终端设备约3亿台,调用量在半年内增长100倍。赛迪顾问的报告指出,MaaS市场发展呈现出Agent加速AI应用开发门槛降低、成本因素影响下大小模型协同成为主流、模型推理工具链生态完善提高部署效率、“公有云+专有云”的MaaS部署模式为企业用户提供安全与成本兼顾的解决方案等特点。预计Tokens成本将进一步下降,规模化增长未到瓶颈,大模型应用落地的爆发才刚刚开始。

原文和模型

【原文链接】 阅读原文 [ 3006字 | 13分钟 ]

【原文作者】 量子位

【摘要模型】 moonshot-v1-32k

【摘要评分】 ★★★★★