反转了?在一场新较量中,号称替代MLP的KAN只赢一局

文章摘要

【关 键 词】 多层感知器、Kolmogorov–Arnold Networks、激活函数、机器学习、符号公式表示

多层感知器(MLP)作为深度学习模型的基本组成部分,在机器学习领域具有不可替代的地位。然而,MLP存在一些局限性,如难以解释的表示和网络规模的扩展困难。Kolmogorov–Arnold Networks(KAN)作为一种创新的替代方案,以其准确性和可解释性优于MLP而受到关注。尽管如此,关于KAN和MLP的选择仍存在争议。

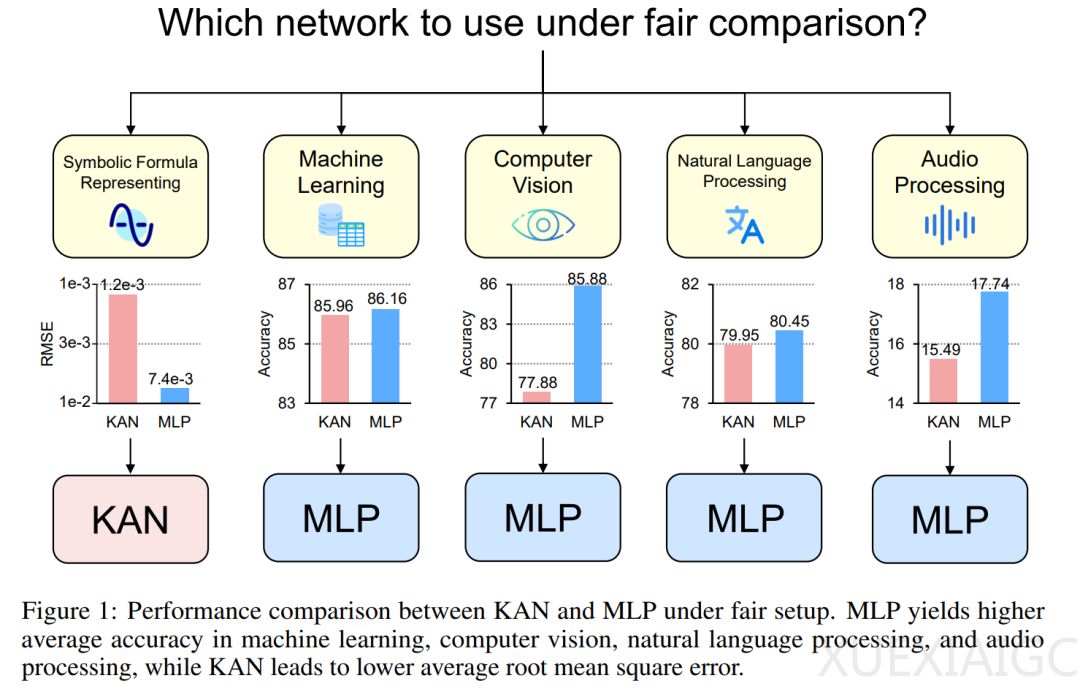

新加坡国立大学的研究者在控制参数或浮点运算(FLOP)的条件下,对KAN和MLP在不同领域的任务进行了全面比较。结果表明,KAN仅在符号公式表示任务中优于MLP,而在其他任务中通常不如MLP。KAN的优势源于其使用的B样条激活函数。当MLP使用B样条激活函数替代原有激活函数时,其性能可达到甚至超过KAN。然而,B样条无法进一步提高MLP在计算机视觉等其他任务上的性能。

KAN和MLP的主要区别在于激活函数和线性与非线性运算的顺序。KAN使用具有可学习参数的样条函数作为激活函数,而MLP通常使用ReLU、GELU等固定激活函数。此外,KAN先进行非线性变换再进行线性变换,与MLP的顺序相反。研究者通过比较KAN和MLP在不同任务上的表现,发现激活函数的差异是导致两个模型在功能上存在差异的主要原因。

在机器学习数据集上,MLP在八个数据集中的六个上表现优于KAN。在计算机视觉数据集中,KAN的性能始终不如具有相同参数数量或FLOP的MLP。在音频和文本任务中,MLP也表现优于KAN。然而,在符号公式表示任务中,KAN在八个数据集中的七个上优于MLP。

研究者还发现,在连续学习任务中,KAN的遗忘问题比MLP更严重。这与最初KAN论文中的比较结果不同,因为本文采用了更标准的类递增持续学习设置。

总的来说,尽管KAN在符号公式表示任务中表现优异,但在其他任务中,MLP仍然是更好的选择。激活函数的差异是导致KAN和MLP在不同任务上表现不同的主要原因。这项研究为KAN和MLP的选择提供了更深入的见解,并为未来的研究和应用提供了有价值的参考。

原文和模型

【原文链接】 阅读原文 [ 2616字 | 11分钟 ]

【原文作者】 机器之心

【摘要模型】 moonshot-v1-32k

【摘要评分】 ★★★★★