文章摘要

为了解决世界模型在长期一致性模拟中的挑战,南洋理工大学、北京大学王选计算机技术研究所和上海人工智能实验室的研究人员联合开发并开源了长记忆世界模型WORLDMEM。该模型的核心在于其独特的记忆机制,通过构建一个包含记忆单元的存储库,每个记忆单元都储存着记忆帧和状态信息,如姿势和时间戳。这种设计能够基于状态信息有效地从记忆帧中提取相关信息,从而精准地重构之前观察到的场景,即使在视角或时间间隔显著的情况下也能做到。WORLDMEM的记忆机制相当于一个“记忆库”,持续不断地收集并存储着虚拟世界中的视觉信息和状态信息。

在生成新场景时,记忆机制的作用尤为关键。它能从海量的记忆单元中精准地检索出与当前场景最为相关的部分。该过程并非简单的信息提取,而是基于复杂的推理和匹配,确保所提取的记忆能够与当前的视角、时间点以及场景状态相契合。例如,当虚拟角色在虚拟世界中移动并返回到之前的位置时,记忆机制能够迅速找到之前该位置的记忆帧,并将其细节融入到新生成的场景中,从而保证场景的一致性和连贯性。

记忆机制的另一个重要特点是它的动态更新能力。随着虚拟世界的发展和变化,新的场景不断产生,记忆库也会相应地进行更新。这使得记忆库始终保持着对最新环境状态的记录,同时也保证了记忆单元的质量和相关性。这种动态更新机制不仅提高了场景生成的准确性和一致性,还为虚拟世界的长期演变提供了坚实的基础。

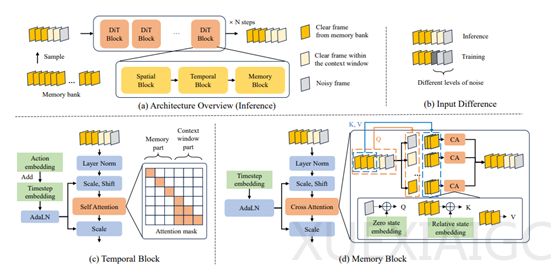

WORLDMEM的交互式世界模拟基础架构基于条件扩散变换器(CDiT)构建,它能够将外部动作信号整合到场景生成过程中,从而实现对虚拟世界的第一人称视角生成。这种设计使得虚拟角色能够根据用户的指令或预设的动作模式,在虚拟世界中自由地移动、探索和互动。WORLDMEM采用了扩散强迫技术进行训练,通过自回归生成的方式,支持虚拟世界在时间维度上的长期模拟。

在交互式世界模拟基础架构中,动作信号的处理尤为关键。WORLDMEM将动作信号通过一个多层感知机投影到嵌入空间中,并采用AdaLN技术将动作嵌入和去噪时间步嵌入相结合。这种处理方式使得动作信号能够以一种更加紧凑和有效的形式融入到场景生成过程中,从而提高了模型对动作信号的响应能力和场景生成的准确性。

记忆检索策略是连接记忆库和场景生成过程的关键环节,它负责从庞大的记忆库中精准地挖掘出与当前场景最为相关的信息。这一过程的效率和准确性直接关系到场景生成的质量和一致性。记忆检索策略的核心在于一种基于帧对相似度的贪婪匹配算法,通过计算记忆帧与当前帧之间的相似度,来确定哪些记忆帧对当前场景的生成最为重要。

在筛选出置信度最高的记忆帧后,记忆检索策略还会进一步应用相似性过滤。这一过程的目的是去除那些与已选记忆帧过于相似的冗余记忆单元,从而确保所检索到的记忆帧在信息上的多样性和互补性。通过这种方式,记忆检索策略不仅提高了检索效率,还增强了场景生成的质量和一致性。

原文和模型

【原文链接】 阅读原文 [ 1630字 | 7分钟 ]

【原文作者】 AIGC开放社区

【摘要模型】 deepseek-v3

【摘要评分】 ★★★★☆