出走 36 天后,OpenAI 灵魂人物 Ilya 官宣新公司,剑指安全超级智能!

文章摘要

【关 键 词】 人工智能、超级智能、安全技术、技术挑战、创新突破

Ilya Sutskever,一位在人工智能领域具有深远影响的科学家,在离开工作近十年的OpenAI后,宣布了其新公司的成立,名为Safe Superintelligence Inc(SSI)。该公司的核心目标是创建安全的超级智能(Safe SuperIntelligence),旨在解决这个时代最紧迫的技术挑战。

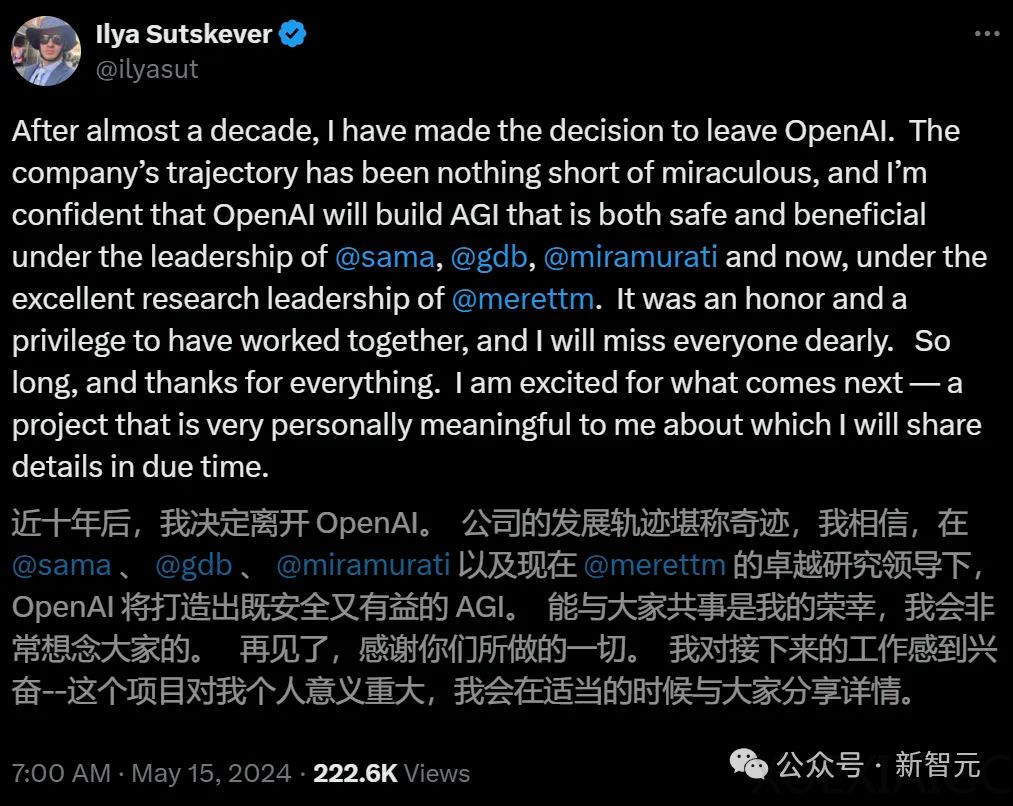

在Ilya宣布离开OpenAI后不久,他通过个人介绍更新了自己的职业方向,表明了他对AI安全的持续关注。SSI的官方介绍强调了超级智能的实现已经触手可及,这不仅是Ilya个人事业的核心,也可能是他与Sam Altman理念不合、选择离开OpenAI的主要原因。

SSI的愿景是实现安全的超级智能,这不仅是公司的使命和名字,也是其整个产品路线图的焦点。Ilya强调,SSI将安全性和能力视为技术问题,需要通过革命性的工程和科学突破来解决。公司计划在提高智能能力的同时,确保安全性始终领先,以便安心地扩展规模。

为了实现这一宏伟目标,SSI正在组建一支由世界上最优秀的工程师和研究人员组成的团队,专注于SSI的研究。Ilya向全球的技术人才发出邀请,希望他们加入SSI,共同完成一生的工作,并帮助解决这个时代最重要的技术挑战。

SSI的联合创始人包括Daniel Levy,他曾在2022年加入OpenAI担任技术员工,并领导了优化团队。Daniel在斯坦福大学获得了计算机科学博士学位,并在机器学习、优化和隐私方面有着深入的研究。

总的来说,Ilya Sutskever通过创建SSI,展示了他对实现安全超级智能的坚定信念和承诺。他和他的团队将致力于推动这一领域的科学和工程进步,以确保超级智能的发展能够造福全人类。随着SSI的成立和发展,我们有理由期待,Ilya和他的团队将为人工智能的未来带来新的突破和可能性。

原文和模型

【原文链接】 阅读原文 [ 3438字 | 14分钟 ]

【原文作者】 Founder Park

【摘要模型】 moonshot-v1-32k

【摘要评分】 ★★★★★