文章摘要

【关 键 词】 中国团队、开源模型、性能卓越、数学提升、代码能力

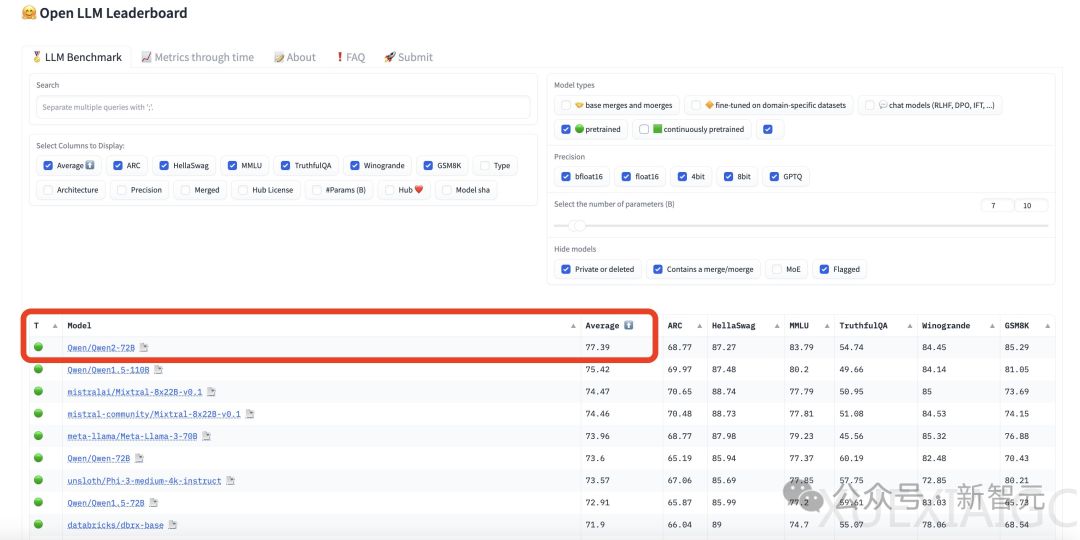

Qwen2-72B,这一由中国团队打造的开源模型,以其卓越性能震撼了全球。该模型一发布便登顶开源LLM排行榜,显著超越了美国的Llama3-70B。相较于前代Qwen1.5,Qwen2-72B在代码和数学能力上实现了显著提升,同时在16个基准测试中展现出与Llama-3-70B-Instruct相匹敌的性能。

特别值得一提的是,Qwen2-70B在数学和代码能力上的进步,得益于其训练过程中加入的高质量多语言数据,覆盖27种语言。此外,其上下文长度支持增大至最高128k token,进一步增强了模型的能力。

Qwen2系列共包含5种不同参数规模的模型,均支持32K上下文,展现了整体性能的代际飞跃。在权威测评榜单OpenCompass中,Qwen1.5-110B已领先众多国内闭源模型,而Qwen2-72B更是在此基础上实现了大幅提升。

在数学、代码、逻辑推理和多语言能力上,Qwen2-72B显著优于Llama3-70B、Mixtral-8x22B等知名模型,尤其在编程语言JS、C++上表现更为突出。小型模型方面,Qwen2系列同样能够超越同等规模甚至更大参数的开源模型。

这一成就不仅彰显了中国在开源模型领域的实力,而且也标志着Qwen2-72B成为了全球AI界的新标杆,为AI技术的发展带来了新的可能性和期待。如今,开发者们可以在魔搭社区和Hugging Face上免费下载这一模型,体验其卓越性能。

原文和模型

【原文链接】 阅读原文 [ 3380字 | 14分钟 ]

【原文作者】 新智元

【摘要模型】 glm-4

【摘要评分】 ★★★★☆

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...