何恺明团队又发新作: MeanFlow单步图像生成SOTA,提升达50%

文章摘要

【关 键 词】 生成模型、流匹配、平均速度、单步生成、ImageNet

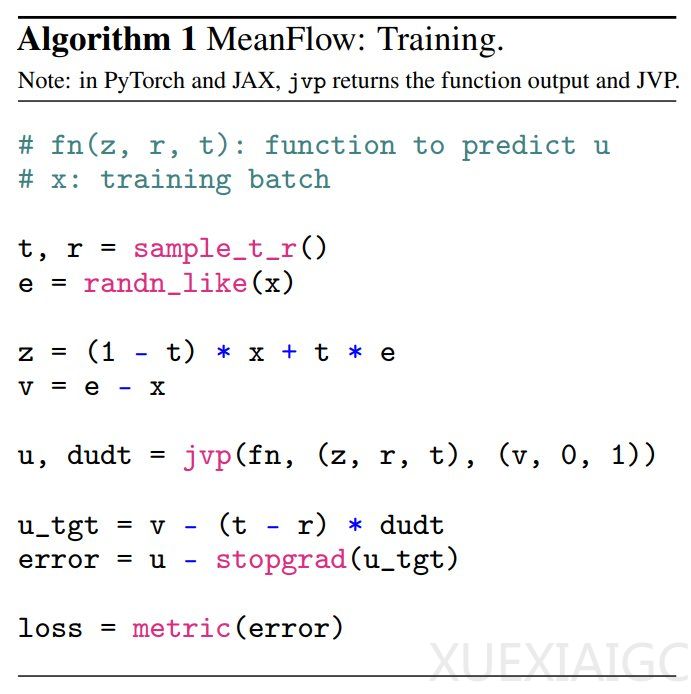

何恺明及其团队近期发布了一项名为MeanFlow的单步生成建模框架,该框架通过引入平均速度的概念,显著改进了现有的流匹配方法。MeanFlow在ImageNet 256×256数据集上取得了3.43的FID分数,这一结果显著优于以往的单步扩散或流模型,且无需预训练、蒸馏或课程学习。生成模型的核心目标是将先验分布转换为数据分布,而流匹配则提供了一个直观且概念简单的框架,用于构建将一个分布传输到另一个分布的流路径。MeanFlow的核心思想是引入一个新的ground-truth场来表示平均速度,而不是流匹配中常用的瞬时速度。

MeanFlow通过使用平均速度(在时间间隔内的位移与时间的比值)来代替流匹配中通常建模的瞬时速度,并推导出平均速度与瞬时速度之间的内在关系,作为指导网络训练的原则性基础。基于这一基本概念,研究团队训练了一个神经网络来直接建模平均速度场,并引入损失函数来奖励网络满足平均速度和瞬时速度之间的内在关系。此外,MeanFlow框架可以自然地整合无分类器引导(CFG),并且在采样时无需额外成本。

在实验部分,MeanFlow在单步生成建模中表现出了强大的性能。在ImageNet 256×256数据集上,仅使用1-NFE(Number of Function Evaluations)就达到了3.43的FID分数,这一结果显著优于之前同类方法的最佳水平,相对性能提升达到50%到70%。此外,MeanFlow是一个自成一体的生成模型,完全从头开始训练,没有任何预训练、知识蒸馏或课程学习。该研究大幅缩小了单步扩散/流模型与多步研究之间的差距。

在进一步的实验中,MeanFlow在2-NFE生成中实现了2.20的FID分数,与多步扩散/流模型的领先基线模型相当。这一结果表明,few-step扩散/流模型可以媲美其多步模型。值得注意的是,MeanFlow方法是独立的,完全从头开始训练,无需使用任何预训练、蒸馏或课程学习,就取得了出色的结果。在CIFAR-10(32×32)上的无条件生成结果中,MeanFlow与先前的方法相比也具有竞争力。

总的来说,MeanFlow通过引入平均速度的概念,显著提升了单步生成建模的性能,并在多个数据集上取得了优异的实验结果。这一研究不仅推动了生成模型的发展,还为未来的相关研究提供了新的思路和方法。

原文和模型

【原文链接】 阅读原文 [ 1185字 | 5分钟 ]

【原文作者】 机器之心

【摘要模型】 deepseek-v3

【摘要评分】 ★★☆☆☆