作者信息

【原文作者】 AIGC开放社区

【作者简介】 专注AIGC领域的专业社区,关注微软OpenAI、百度文心一言、讯飞星火等大语言模型(LLM)的发展和应用落地,聚焦LLM的市场研究和AIGC开发者生态,欢迎关注!

【微 信 号】 AIGCOPEN

文章摘要

【关 键 词】 AIGC、大语言模型、数据分析、Gemini 1.5、OpenAI

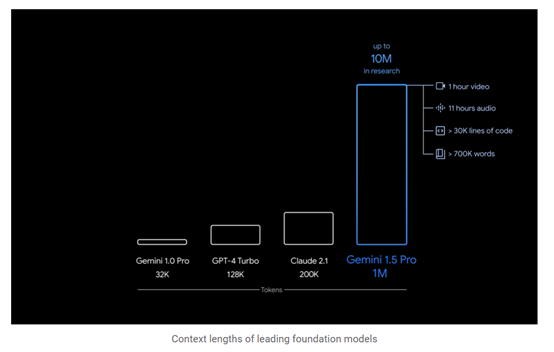

AIGC领域的专业社区关注了微软、OpenAI、百度文心一言、讯飞星火等大语言模型(LLM)的发展和应用落地,特别是谷歌发布的Gemini 1.5模型。尽管在发布当天遭遇了OpenAI的Sora挑战,Gemini 1.5仍成为首个支持100万tokens上下文的基础大模型,能够处理大量数据,如1小时视频、11小时音频或100,000行代码。

超复杂文本分析:Gemini 1.5能够无缝分析、分类和总结大量内容,如阿波罗11号登月任务记录,甚至能解释PDF中的特定内容。

跨模式理解和推理:模型能够执行针对不同模式(包括视频)的理解和推理任务,如分析无声电影的情节点和事件,以及辨别视频是否由AI生成。

解读复杂代码:Gemini 1.5能解读大量代码并进行修改、注释、优化。例如,解释动画Little Tokyo的demo控制方式,并撰写功能代码。

Gemini 1.5模型介绍:基于Transformer和MoE架构,MoE模型通过激活最相关的专家路径来增强效率。与前代相比,Gemini 1.5在多个领域实现显著提升,性能在多个基准测试中优于1.0 Pro,与Ultra 1.0相当。在“大海捞针”评估中,Gemini 1.5在100万标记的数据块中准确找到嵌入文本。

本文素材来源于谷歌官网,如有侵权请联系删除。

原文信息

【原文链接】 阅读原文

【原文字数】 792

【阅读时长】 3分钟