文章摘要

【关 键 词】 扩散模型、微调方法、SaRA方法、图像生成、参数优化

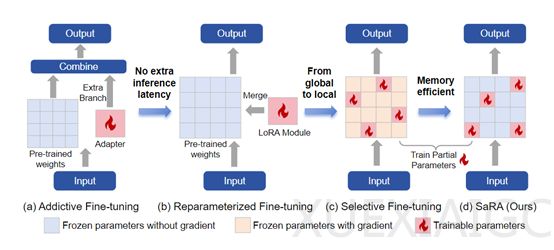

近年来,扩散模型在图像、视频和3D生成等任务中发挥了重要作用,但在将预训练模型微调应用于实际业务场景时面临挑战。现有微调方法如AFT、RFT和SFT存在局限性,如AFT需额外模块和参数,RFT存在过拟合风险,SFT参数选择复杂且效果不佳。

针对这些问题,上海交通大学和腾讯优图实验室的研究人员提出了一种新的微调方法SaRA。SaRA利用预训练过程中看似无效的参数,这些参数在模型输出中影响不大,但具有学习新知识的潜力。SaRA通过对这些参数重新训练,使模型学习更多任务特定知识,如图像风格迁移。

SaRA采用核范数低秩约束和渐进参数调整策略,避免模型过拟合,提高泛化能力。首先,SaRA对预训练模型参数进行重要性分析,识别出看似无效但潜在有效的参数。然后,基于核范数的低秩稀疏训练方案,对参数矩阵施加低秩约束,避免微调过程中过拟合。

SaRA通过优化稀疏权重矩阵学习特定任务知识,同时保留预训练模型知识。这种策略提高了模型适应性,降低了参数数量和计算成本。SaRA还引入渐进式参数调整策略,在微调过程中不断重新评估和选择参数,确保所有潜在有效参数得到充分利用,提高新任务处理的灵活性和效率。

总之,SaRA作为一种新的预训练模型微调方法,在图像生成等任务中展现出优势。它通过重新激活和训练预训练过程中看似无效的参数,提高模型对新任务的适应性和泛化能力。SaRA的低秩稀疏训练方案和渐进式参数调整策略,进一步优化了微调过程,降低了计算成本,提升了模型在新任务中的性能。

原文和模型

【原文链接】 阅读原文 [ 1050字 | 5分钟 ]

【原文作者】 AIGC开放社区

【摘要模型】 moonshot-v1-32k

【摘要评分】 ★★☆☆☆

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...