模型信息

【模型公司】 月之暗面

【模型名称】 moonshot-v1-32k

【摘要评分】 ★★★★★

文章摘要

【关 键 词】 AIGC、Genie、DeepMind、ST-Transformer、动力学模型

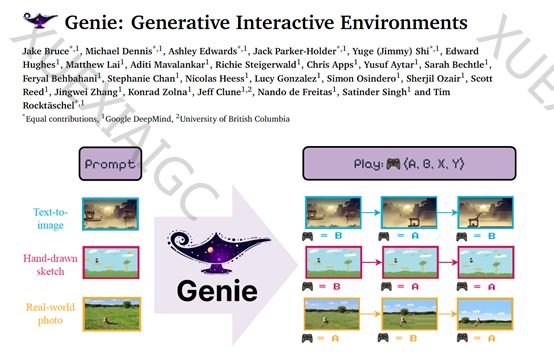

本文介绍了谷歌DeepMind推出的首个无需数据标记、无监督训练的生成交互模型——Generative Interactive Environments(简称“Genie”)。Genie拥有110亿参数,能够根据图像、真实照片甚至草图生成各种可控制动作的视频游戏。Genie的神奇功能主要得益于3万小时、6800万段游戏视频的大规模训练,且训练过程中未使用任何真实动作标签或其他特定提示。Genie是一个通用基础模型,其学到的潜在动作关系、序列、空间可应用于其他领域。

Genie的核心架构采用了ST-Transformer,结合了Transformer模型的自注意力机制与时空数据的特性,有效处理视频、多传感器时间序列、交通流量等时空数据。ST-Transformer通过捕捉数据在时间和空间上的复杂依赖关系,提高了对时空序列的理解和预测能力。Genie的架构主要由视频分词器、潜在动作模型和动力学模型三大模块组成。

视频分词器基于VQ-VAE,将原始视频帧压缩成离散的记号表示,降低维度并提高视频生成质量。潜在动作模型通过无监督学习,从原始视频中推断出状态变化对应的潜在动作,并实现对每一帧的控制。动力学模型则基于潜在动作模型学习到的动作关系,预测下一帧的视频。

Genie的输入包括前一帧的图像表示和当前帧的动作表示,采用基于Transformer架构的编码器进行编码。编码器将图像和动作表示融合后,输入动力学模型进行预测。Genie的研究成果展示了其在AIGC领域的潜力,为开发者生态和市场研究提供了新的方向。

原文信息

【原文链接】 阅读原文

【阅读预估】 1088 / 5分钟

【原文作者】 AIGC开放社区

【作者简介】 专注AIGC领域的专业社区,关注微软OpenAI、百度文心一言、讯飞星火等大语言模型(LLM)的发展和应用落地,聚焦LLM的市场研究和AIGC开发者生态,欢迎关注!