是时候停止炒作「o3是AGI」了!背后15人安全对齐团队大盘点

文章摘要

【关 键 词】 AI模型、人工通用智能、推理速度、安全评估、审议式对齐

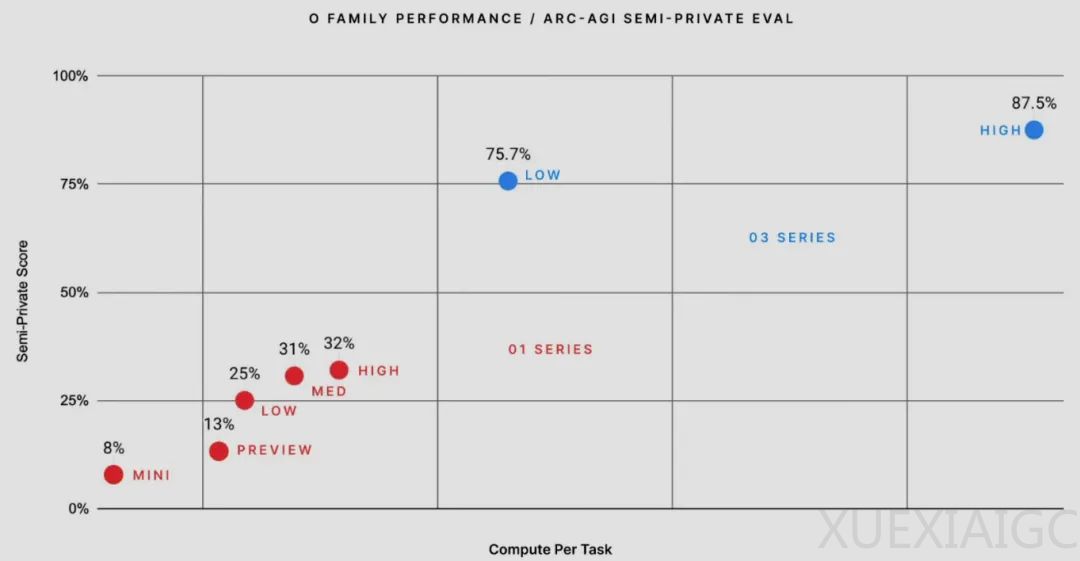

OpenAI最近发布了推理模型o3系列,该模型在ARC-AGI基准上表现出色,成为首个突破该基准的AI模型,引发业界对AGI(人工通用智能)的热烈讨论。o3系列模型的能力远超以往任何推理模型,最低可达75.7%,最高可达87.5%。尽管有人宣称AGI已经实现,但知名博主、AI研究者“elvis”认为o3系列并非AGI,人们甚至无法访问这些模型。OpenAI也明确表示还有很多需要改进的地方。

o3系列模型虽然在编码和数学领域表现出色,但AGI需要胜任人类能做的所有事情。真正的AGI应该是适应性强的,即使资源紧张也能运行。然而,o3的运行成本高得离谱,这显然不是AGI的意义所在。尽管如此,o3无疑是一次巨大的进步,尤其是推理速度提升、成本降低且兼顾性能的o3-mini,它更加经济高效,并使用全新的安全评估方法审议式对齐(deliberative alignment)。

审议式对齐是一种直接教模型安全规范的新范式,训练模型在回答之前明确回忆规范并准确执行推理。OpenAI使用这种方法来对齐包括o3-mini在内的o系列模型,实现对OpenAI安全政策的高度精确遵守,无需人工编写的思路或答案。o3-mini对齐范式作者包括Melody Y. Guan、Manas Joglekar、Eric Wallace、Saachi Jain、Boaz Barak、Alec Heyla、Rachel Dias、Andrea Vallone、Hongyu Ren、Jason Wei、Hyung Won Chung、Sam Toyer、Johannes Heidecke、Alex Beutel和Amelia Glaese等。这些作者的研究背景和经历为o3系列模型的发展提供了坚实的基础。

原文和模型

【原文链接】 阅读原文 [ 2730字 | 11分钟 ]

【原文作者】 机器之心

【摘要模型】 moonshot-v1-32k

【摘要评分】 ★★☆☆☆